Modul 6: Online- und KI-gestützte geschlechtsspezifische Gewalt (GBV)

Untersuchung, wie geschlechtsspezifische Gewalt in digitalen Räumen sichtbar wird – und wie KI Schaden sowohl verstärken als auch helfen kann, ihn zu verhindern.

Kapitelüberblick

Willkommen zu diesem Modul über Online- und KI-gestützte geschlechtsspezifische Gewalt (GBV). Dieses Modul beleuchtet, wie geschlechtsspezifische Gewalt (GBV) in Online-Räumen stattfindet, und untersucht die doppelte Rolle Künstlicher Intelligenz (KI) – sowohl bei der Ermöglichung als auch bei der Bekämpfung dieser Formen von Gewalt.

Lernziele des Kapitels

Am Ende dieses Moduls können Sie:

- die wichtigsten Formen von Online- und KI-gestützter GBV identifizieren.

- das Online–Offline-Kontinuum verstehen und nachvollziehen, wie Gewalt eskalieren kann.

- die doppelte Rolle von KI bei der Aufrechterhaltung und Eindämmung von GBV analysieren.

- Strategien für digitale Sicherheit und Unterstützung in der Jugendarbeit anwenden.

💻 Formen von Online-Geschlechtsspezifischer Gewalt

In der heutigen digitalen Welt ist das Internet zentral dafür, wie junge Menschen sich vernetzen, kommunizieren und erkunden, wer sie sind. Doch neben diesen Möglichkeiten bringen digitale Räume auch ernsthafte Risiken mit sich – besonders für Mädchen, junge Frauen, LGBTIQA+-Jugendliche und andere marginalisierte Gruppen. Technologie ist nicht neutral. Sie kann unterstützen, aber auch dazu genutzt werden, zu kontrollieren, zu beschämen oder zu verletzen.

Online-Geschlechtsspezifische Gewalt (GBV) bezeichnet schädliche Handlungen, die über digitale Technologien ausgeübt werden und Menschen aufgrund ihres Geschlechts, ihrer Geschlechtsidentität oder ihrer sexuellen Orientierung angreifen. Nach Angaben des Europäischen Instituts für Gleichstellungsfragen (EIGE) haben mehr als die Hälfte der jungen Frauen (52 %) in der EU irgendeine Form von Online-Gewalt erlebt – darunter Drohungen, Belästigung und die nicht-einvernehmliche Weitergabe intimer Bilder (EIGE, 2022). Auch LGBTIQA+-Jugendliche, rassifizierte Minderheiten und Jugendliche mit Behinderungen sind überproportional betroffen.

Manche Formen von Online-GBV sind laut und öffentlich – etwa Hasskommentare oder manipulierte Bilder. Andere sind verborgen oder als „normal“ getarnt, zum Beispiel kontrollierende Nachrichten in einer Beziehung oder wenn eine fremde Person online Vertrauen aufbaut, um später Missbrauch auszuüben. Doch alle Formen von Online-GBV können tiefe emotionale, psychische und sogar körperliche Auswirkungen haben. Sie können offline eskalieren – und das tun sie oft.

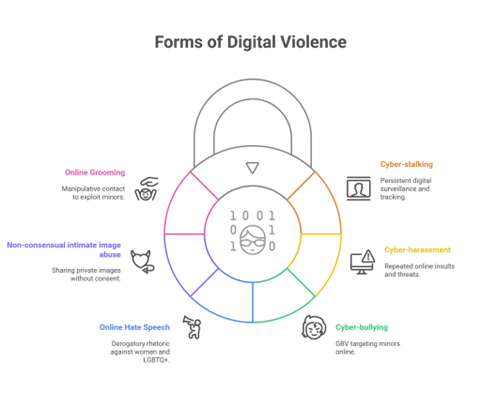

Dieser Abschnitt stellt sieben zentrale Formen von Online-GBV vor, die Fachkräfte in der Jugendarbeit und Bildung erkennen können sollten. Jede Form wird mit einfachen Definitionen und konkreten Beispielen erklärt – aus Plattformen, die junge Menschen tatsächlich nutzen, wie WhatsApp, TikTok, Discord oder Instagram. Die Zeichen zu kennen, ist der erste Schritt, um Schaden zu verhindern und Unterstützung anzubieten.

1. Cyberstalking

Nutzung digitaler Werkzeuge, um die Aktivitäten oder den Aufenthaltsort einer Person ohne Einwilligung zu überwachen. Das kann das Verfolgen über GPS-Apps wie Snap Map, das obsessive Prüfen des Online-Status oder das Ausnutzen geteilter Passwörter zum Zugriff auf Nachrichten einschließen.

Beispiel: Der Ex-Freund einer Jugendlichen verfolgt weiterhin ihren Standort über Snap Map, obwohl sie die Beziehung beendet und ihn auf Instagram blockiert hat.

2. Cyberbelästigung

Wiederholte, unerwünschte Nachrichten, die aggressiv, bedrohlich, sexualisiert oder demütigend sind. Das passiert häufig in Direktnachrichten, Gruppenchats oder über anonyme Accounts und kann schnell eskalieren.

Beispiel: Eine Schülerin erhält täglich Sprachnachrichten von einer Mitschülerin, die sie beschimpft und damit droht, persönliche Geheimnisse öffentlich zu machen.

3. Cybermobbing

Ein Muster gezielter Online-Grausamkeit gegenüber Minderjährigen – meist durch Gleichaltrige. Dazu können Memes, Identitätsvortäuschung, öffentliches Bloßstellen oder Ausschluss aus digitalen Räumen gehören (z. B. aus WhatsApp-Gruppen oder „privaten Stories“).

Beispiel: Eine Gruppe verbreitet ein gephotoshopptes Meme über den Körper einer Mitschülerin und markiert sie in TikTok-Kommentaren.

4. Online-geschlechtsspezifische Hassrede

Beschimpfende oder bedrohliche Sprache, die sich gegen eine Person aufgrund ihres Geschlechts, ihrer sexuellen Orientierung oder Identität richtet. Oft wird sie durch Ironie, Memes oder „Witze“ normalisiert – ist aber zutiefst schädlich.

Beispiel: Eine nichtbinäre Person wird in einem Discord-Server wiederholt falsch gegendert und nach dem Teilen ihrer Pronomen aufgefordert, „sich umzubringen“.

5. Nicht-einvernehmlicher Missbrauch intimer Bilder (manchmal „Revenge Porn“ genannt)

Das Teilen oder Androhen, intime Bilder oder Videos ohne Einwilligung der betroffenen Person zu verbreiten. Dazu zählen echte Fotos ebenso wie KI-manipulierte Inhalte, etwa Deepfakes.

Beispiel: Jemand leakt ein Nacktfoto, das im Vertrauen geschickt wurde, oder erstellt ein Deepfake-Video und verbreitet es in anonymen Foren.

6. Online-Grooming

Wenn jemand absichtlich über längere Zeit Vertrauen zu einer minderjährigen Person über Online-Kontakt aufbaut – meist, um sie sexuell zu manipulieren oder auszubeuten. Täter*innen geben sich häufig als Gleichaltrige aus oder bieten Bestätigung, Geschenke oder Lob.

Beispiel: Ein 14-jähriges Mädchen, das Online-Games spielt, wird von einer Person in private Chats eingeladen, die ihr schmeichelt und später nach Fotos und Geheimnissen fragt.

Hinweis: Grooming beginnt oft nicht mit Drohungen – sondern mit Freundlichkeit. Junge Menschen merken möglicherweise nicht, dass sie manipuliert werden.

7. Doxxing

Die öffentliche Veröffentlichung persönlicher Informationen (Name, Adresse, Telefonnummer, Schule), um einzuschüchtern oder andere anzustacheln, die Person anzugreifen. Doxxing folgt oft auf Online-Streit, Aktivismus oder Coming-out-Posts.

Beispiel: Nachdem eine jugendliche Person auf TikTok über LGBTIQA+-Rechte postet, veröffentlicht ein Troll-Account ihre Wohnadresse in den Kommentaren.

Jede Form von Online-GBV kann sich unterschiedlich zeigen, aber alle können die psychische Gesundheit, das Selbstvertrauen, die Sicherheit und die Freiheit junger Menschen beeinträchtigen. Fachkräfte in Jugendarbeit und Bildung sowie Peer-Allies spielen eine zentrale Rolle dabei, Warnsignale zu erkennen, sicherere digitale Umgebungen zu schaffen und jungen Menschen deutlich zu machen, was nicht okay ist. Abbildung 1 fasst einige Formen von Online-GBV zusammen.

| Form | Definition | Veranschaulichende Evidenz | Praxis der Jugendarbeit | Beispielszenario |

|---|---|---|---|---|

| Cyberstalking & digitale Überwachung | Anhaltende, unerwünschte Überwachung mittels Apps, GPS oder Logins, um Bewegungen oder Online-Aktivitäten einer Person zu verfolgen. | Rogers et al. (2022) identifizieren gängige Taktiken, darunter Spyware, geteilte Cloud-Passwörter und die Ausnutzung von „Find My Phone“. | Fragen: Sind junge Menschen sich versteckter Apps oder geteilter Zugangsdaten bewusst? Fördern Sie Technik-Check-ups und digitale Grenzen. | Eine Jugendliche berichtet, dass ihr*e Ex auch nach der Trennung noch weiß, wo sie sich aufhält – obwohl sie ihn blockiert hat. |

| Cyberbelästigung | Wiederholtes Versenden von Drohungen, Beleidigungen oder herabwürdigenden Inhalten über digitale Plattformen. | Henry & Powell (2018) zeigen, dass Online-Missbrauch häufig klassische IPV-Muster nachahmt – insbesondere nach Trennungen. | Unterstützen Sie Jugendliche dabei, Beweise zu sichern, Inhalte auf Plattformen zu melden und mit emotionalen Folgen umzugehen. | Ein*e Schüler*in erhält täglich beleidigende Sprachnachrichten von einer Klassenkameradin in einem Gruppenchats. |

| Cybermobbing | Belästigung oder Demütigung Minderjähriger online, häufig im schulischen oder peerbezogenen Kontext. | Stonard et al. (2014) heben hervor, wie Technologie Mobbing von der Schulzeit in private Räume ausdehnt. | Fördern Sie Gruppennormen in Peer-Räumen; nutzen Sie Rollenspiele, um Empathie und Interventionskompetenzen aufzubauen. | Eine Gruppe von Mädchen erstellt Memes über den Körper einer Mitschülerin und teilt sie auf Snapchat. |

| Online-geschlechtsspezifische Hassrede | Aggressive, abwertende Rhetorik, die sich gegen jemanden aufgrund des Geschlechts oder der Identität richtet. | Powell et al. (2022) beschreiben, wie Hassrede Frauen und LGBTIQA+-Personen durch „geschichtete“ Angriffe trifft (z. B. Kombination von Sexismus und Homophobie). | Bereiten Sie Jugendliche darauf vor, Hass zu erkennen und darauf zu reagieren – nicht nur zu ignorieren oder „weiterzuscrollen“. | Ein*e nichtbinäre*r Jugendliche*r wird in einem Gaming-Discord-Server wiederholt falsch gegendert und mit Schimpfwörtern beleidigt. |

| Nicht-einvernehmlicher Missbrauch intimer Bilder („Revenge Porn“) | Teilen privater Bilder oder Videos ohne Einwilligung, häufig durch Ex-Partner*innen oder Peers. | Lippman & Campbell (2014) zeigen, dass Jugendliche sich oft unter Druck gesetzt fühlen, Nacktbilder zu teilen – und dass diese Bilder häufig ohne Einwilligung weiterverbreitet werden. | Vermitteln Sie Jugendlichen rechtliche Rechte, das Prinzip der Einwilligung und die emotionalen Folgen des Bildteilens. | Ein Junge droht, das Foto seiner Ex zu posten, wenn sie nicht zustimmt, wieder mit ihm zu reden. |

| Online-Grooming | Manipulation eines Minderjährigen in Vertrauen oder Abhängigkeit zu sexuellen Zwecken – online oder offline. | Wolak et al. (2008) fanden, dass Grooming meist mit Schmeichelei beginnt und sich schrittweise zu Manipulation entwickelt. | Betonen Sie, wie Täter*innen Vertrauen aufbauen – nicht nur mit Drohungen arbeiten; stärken Sie Medienkompetenz. | Ein*e 15-Jährige*r wird von einer fremden Person in einen privaten Chat eingeladen, die Gaming-Belohnungen verspricht. |

🤖 Die Rolle von Künstlicher Intelligenz bei geschlechtsspezifischer Gewalt

Künstliche Intelligenz (KI) verändert, wie wir kommunizieren, interagieren und auf Informationen zugreifen – insbesondere in digitalen Räumen, in denen junge Menschen viel Zeit verbringen. Doch neben ihren Vorteilen verändert KI auch, wie Schaden entstehen kann, einschließlich geschlechtsspezifischer Gewalt (GBV).

Diese Einheit untersucht, wie KI-Technologien sowohl zur Ausübung von Gewalt missbraucht werden können als auch Prävention und Unterstützung stärken können. Sie bietet praxisnahe Einblicke für Fachkräfte der Jugendarbeit und Bildung, die die Werkzeuge, Risiken und Chancen verstehen möchten, die KI für ihre Arbeit mit sich bringt.

Die Diskussion beleuchtet zudem die ethischen Herausforderungen, die mit dem Einsatz automatisierter Systeme in sensiblen Kontexten einhergehen, und reflektiert die Grenzen aktueller Datensätze und Designansätze – insbesondere dort, wo Perspektiven junger Menschen oder marginalisierter Communities fehlen.

Wichtig ist: KI-gestützte Gewalt sollte nicht als etwas völlig Neues verstanden werden. Sie stellt vielmehr eine Fortsetzung geschlechtsspezifischer Gewalt über neue digitale Kanäle dar, nicht eine eigenständige oder isolierte Form. Als Teil des Online-Offline-Kontinuums von GBV spiegeln viele der heutigen Formen – etwa Überwachung, Zwang oder bildbasierter Missbrauch – Muster von Macht und Kontrolle wider, die auch offline existieren. Technologie hat diese Verhaltensweisen nicht geschaffen, aber sie hat sie verstärkt, automatisiert und skaliert – oft auf eine Weise, die schwerer zu erkennen oder zu beantworten ist.

Künstliche Intelligenz kann ein mächtiges Werkzeug sein – aber wie viele Technologien kann sie auch missbraucht werden. Im Kontext von GBV hat KI neue Methoden ermöglicht, mit denen Täter*innen andere belästigen, beschämen oder kontrollieren können – insbesondere in digitalen Räumen, in denen junge Menschen am aktivsten sind.

Eine der beunruhigendsten Entwicklungen ist der Einsatz von Deepfakes – KI-generierte Bilder oder Videos, die das Gesicht einer Person ohne deren Einwilligung in eine pornografische Szene einfügen. Solche Fälschungen werden häufig über soziale Medien oder verschlüsselte Messenger geteilt. Selbst wenn sie eindeutig gefälscht sind, berichten Betroffene – oft Mädchen, junge Frauen und LGBTIQA+-Jugendliche – von Scham, Angst und sozialer Isolation (Umbach et al., 2024).

Ein weiterer häufiger Missbrauch von KI ist die Erstellung von Belästigungs-Bots: automatisierte Accounts, die so programmiert sind, dass sie in großem Umfang gewalttätige, abwertende oder drohende Nachrichten versenden. Solche Bots richten sich oft gegen junge Aktivist*innen, Influencer*innen oder Personen, die öffentlich über Geschlecht, Sexualität oder Gerechtigkeit sprechen. Die schiere Menge der Nachrichten kann den Missbrauch unaufhörlich und unausweichlich wirken lassen (Powell et al., 2022).

KI kann auch ohne direkte böswillige Absicht zu Schaden beitragen. Plattform-Algorithmen, die Inhalte mit hoher Interaktion priorisieren, verstärken häufig Beiträge, die Wut oder Empörung auslösen. Das bedeutet, dass misogynistische oder transfeindliche Inhalte oft mehr Menschen erreichen – nicht weil Plattformen sie gezielt fördern, sondern weil ihre KI-Systeme darauf ausgelegt sind, Aufmerksamkeit zu optimieren, nicht Sicherheit (Henry & Powell, 2018).

Schließlich können KI-gesteuerte Technologien in Smart Homes, Wearables oder Mental-Health-Apps zu Überwachungswerkzeugen umfunktioniert werden. Ein*e Täter*in könnte solche Systeme nutzen, um den Standort zu verfolgen, private Nachrichten auszulesen oder emotionale Zustände ohne Einwilligung zu interpretieren. Betroffene merken möglicherweise nicht einmal, dass sie überwacht werden (Powell et al., 2022).

Diese Risiken unterstreichen eine zentrale Botschaft: KI verursacht keinen Missbrauch – aber sie kann von Menschen mit schädlichen Absichten als Waffe eingesetzt werden. Für Fachkräfte der Jugendarbeit, Sozialarbeit und Bildung ist es entscheidend zu verstehen, wie diese Technologien funktionieren und wie sie mit bestehenden Mustern offline ausgeübter Gewalt zusammenhängen, wie in Tabelle 2 dargestellt.

| Missbrauchsmethode | Beschreibung | Beispiel aus der Praxis | Referenz |

|---|---|---|---|

| Deepfakes | KI-generierte Bilder oder Videos, die das Gesicht einer Person in sexualisierte Inhalte einfügen | Eine Jugendliche entdeckt ein pornografisches Video, in dem ihr Gesicht mithilfe von Deepfake-Technologie überlagert wurde und das online kursiert | Umbach et al. (2024) |

| Belästigungs-Bots | Automatisierte Accounts, die drohende oder herabwürdigende Inhalte massenhaft verbreiten – oft gegen Aktivist*innen oder marginalisierte Gruppen gerichtet | Eine junge Klimaaktivistin erhält nach einem öffentlichen Vortrag hunderte KI-generierte Beschimpfungen über verschiedene Plattformen hinweg | Powell et al. (2022) |

| Algorithmische Verstärkung von Hass | Plattform-Algorithmen priorisieren hasserfüllte oder aufwieglerische Beiträge für mehr Engagement und setzen Zielpersonen dadurch massenhafter Anfeindung aus | LGBTIQA+-Influencer*innen berichten nach Posts zu Pride von einem starken Anstieg an Hass, ausgelöst durch Empfehlungsalgorithmen | Henry & Powell (2018) |

| Datenausbeutung | KI-Systeme leaken private Daten über „smarte“ Geräte oder schließen ohne Einwilligung auf sensible Informationen | Ein smarter Lautsprecher im Zuhause eines Teens zeichnet private Streitgespräche auf und übermittelt die Protokolle ohne Einwilligung an einen Cloud-Server | Powell et al. (2022) |

Auch wenn KI-Technologien missbraucht werden können, um Schaden zu verursachen, haben sie gleichzeitig ein erhebliches Potenzial, Prävention, Früherkennung und Unterstützung für Betroffene in Fällen geschlechtsspezifischer Gewalt (GBV) zu stärken. Wenn KI ethisch entwickelt und eingesetzt wird, kann sie Sicherheit erhöhen und den Zugang zu Unterstützungsangeboten für von Online-Missbrauch betroffene Personen verbessern.

Eine der wirksamsten Anwendungen von KI ist das Erkennen und Entfernen schädlicher Inhalte. Tools, die Bilderkennung nutzen – etwa nach dem Vorbild von Microsofts PhotoDNA – helfen Plattformen bereits dabei, bekanntes Material sexualisierter Gewalt gegen Kinder (CSAM) zu identifizieren und zu blockieren. Diese Systeme gleichen von Nutzer*innen hochgeladene Bilder mit sicheren Datenbanken bereits gemeldeter Missbrauchsinhalte ab. Auch wenn solche Tools nicht verhindern können, dass neue Bilder entstehen, sind sie ein wichtiger Schutzmechanismus gegen die Verbreitung schädlichen Materials (UNICEF, 2022).

KI wird außerdem eingesetzt, um Chatbots und virtuelle Assistent*innen zu betreiben, die Betroffenen helfen, die passende Unterstützung zu finden. Solche Angebote sind besonders hilfreich für junge Menschen, die unsicher sind, persönlich mit jemandem zu sprechen. Chatbots können Nutzer*innen durch Fragen zu ihren Erfahrungen begleiten und sie mit geeigneten psychosozialen, rechtlichen oder Notfall-Diensten verbinden. Wenn sie nach traumasensiblen Prinzipien entwickelt und in mehreren Sprachen verfügbar sind, können sie einen sicheren ersten Schritt in Richtung Hilfe bieten (Musharu et al., 2025).

Natural Language Processing (NLP) – eine Form von KI, die Computern hilft, menschliche Sprache zu verstehen – wird genutzt, um Hassrede zu erkennen und zu blockieren. Plattformen wie X (ehemals Twitter), Instagram und TikTok setzen zunehmend NLP-Modelle ein, um Posts nach beleidigender oder bedrohlicher Sprache zu scannen und Maßnahmen zu ergreifen. Auch wenn diese Tools nicht perfekt sind, reduzieren sie die Menge sichtbarer Gewalt und können Nutzer*innen vor den psychischen Folgen gezielter Belästigung schützen (Powell et al., 2022).

Zudem gibt es erste Erprobungen von KI in Prävention und Frühwarnsystemen. Einige Apps analysieren Nutzerverhalten – etwa Tonfall von Nachrichten oder Kontaktfrequenz – um Muster zu erkennen, die auf ein Risiko hindeuten können. In manchen Kontexten häuslicher Gewalt wird KI erprobt, um Hochrisikosituationen zu identifizieren, bevor es zu körperlicher Gewalt kommt. Solche Vorhersagemodelle müssen sehr sorgfältig eingesetzt werden, um Fehlalarme oder Datenschutzverletzungen zu vermeiden, zeigen aber Potenzial für bessere Frühintervention (Henry & Powell, 2018).

Entscheidend für die Nützlichkeit solcher Tools ist nicht nur die Technologie, sondern auch, wie sie eingeführt, erklärt und geregelt wird. Tools, die gemeinsam mit Jugendlichen, Betroffenen und zivilgesellschaftlichen Organisationen entwickelt werden, bilden reale Bedarfe eher ab und genießen mehr Vertrauen (siehe Tabelle 3).

| KI-Anwendung | Beschreibung | Beispiel | Referenz |

|---|---|---|---|

| Bilderkennung | KI-Tools erkennen bekanntes oder vermutetes Missbrauchsmaterial (z. B. nicht-einvernehmliche Nacktbilder) und markieren/entfernen es von Plattformen | Meta nutzt PhotoDNA-ähnliche Tools, um Uploads bekannten Materials sexualisierter Gewalt gegen Kinder (CSAM) zu blockieren | UNICEF (2022) |

| Triage-Chatbots | KI-gestützte Bots leiten Betroffene rund um die Uhr zu passenden Angeboten – mit traumasensiblen Gesprächsabläufen | Ein*e Jugendliche*r nutzt einen Support-Chatbot auf WhatsApp, um psychosoziale Hilfe in der eigenen Sprache zu finden | Musharu et al. (2025) |

| NLP zur Hasserkennung | Natural Language Processing (NLP) wird genutzt, um misogynistische oder transfeindliche Posts automatisch zu markieren | Twitter setzt Content-Klassifikatoren ein, die auf Datensätzen zu Hassrede trainiert wurden | Powell et al. (2022) |

| Predictive Policing oder Frühwarnsysteme | In einigen Pilotprojekten wird KI genutzt, um Risikomuster in missbräuchlichem Verhalten zu analysieren und Warnungen oder Prävention auszulösen | Prototyp-Apps bewerten Eskalationsmuster in DV-Fällen anhand von SMS-Tonfall + Häufigkeit | Henry & Powell (2018) |

Da KI zunehmend im Kampf gegen geschlechtsspezifische Gewalt (GBV) eingesetzt wird, ist es wichtig, nicht nur ihre Möglichkeiten, sondern auch ihre Grenzen und Risiken zu verstehen. KI-Tools sind nicht neutral. Sie werden geprägt durch die Daten, auf denen sie trainiert sind, durch die Ziele ihrer Entwickler*innen und durch die sozialen Umgebungen, in denen sie eingesetzt werden. Ohne angemessene Aufsicht können diese Tools unbeabsichtigt Ungleichheit verstärken, Betroffene neuen Formen von Schaden aussetzen oder diejenigen nicht schützen, für die sie entwickelt wurden.

Ein zentrales Problem ist Verzerrung (Bias) in KI-Modellen. Viele Systeme zur Erkennung von Hassrede, missbräuchlichen Nachrichten oder schädlichen Bildern werden mit Datensätzen trainiert, die bestimmte Gruppen oder Sprachen unterrepräsentieren. Dadurch kann Missbrauch, der sich gegen Women of Colour, LGBTIQA+-Personen oder nicht-westliche Nutzer*innen richtet, unentdeckt bleiben. In manchen Fällen wurden legitime Ausdrucksformen von Wut oder Frustration durch Betroffene fälschlich als missbräuchlich markiert, während tatsächliche Drohungen online bleiben (Powell et al., 2022).

Ein weiteres Risiko ist mangelnde Transparenz darüber, wie KI-Tools Entscheidungen treffen. Betroffene wissen möglicherweise nicht, warum ein Beitrag entfernt wurde oder warum ein Chatbot eine bestimmte Antwort gegeben hat. Dieses „Black-Box“-Problem verringert das Vertrauen in KI-Systeme und erschwert Verantwortlichkeit. Für junge Menschen, die oft weniger vertraut mit digitalen Rechten sind, kann das zu Verwirrung oder Frustration führen, wenn sie online Hilfe suchen (Henry & Powell, 2018).

Auch der Missbrauch von Überwachung ist ein wachsendes Thema. KI-Tools, die Nutzer*innen eigentlich schützen sollen – etwa Standort-Tracker oder Emotions-Erkennungssoftware – können von Täter*innen als Waffen eingesetzt werden. Wenn Safety-Apps keine strengen Datenschutzmechanismen haben, können sie dazu genutzt werden, Betroffene zu überwachen oder zu kontrollieren, statt zu helfen. Das ist besonders gefährlich in Situationen häuslicher Gewalt, in denen Technologie bereits Teil des Musters coerciver Kontrolle ist (UNESCO, 2023).

Ein weiterer kritischer Punkt ist die geringe Beteiligung junger Menschen am Design solcher Tools. Jugendliche machen oft spezifische Erfahrungen mit Online-Missbrauch, werden aber selten in die Entwicklung digitaler Sicherheitslösungen einbezogen. Das kann zu Tools führen, die schlecht auf ihre Bedürfnisse zugeschnitten sind, eine verwirrende Sprache verwenden oder wichtigen Kontext – etwa Slang, kulturelle Normen oder plattformspezifische Risiken – übersehen (Musharu et al., 2025).

Schließlich fehlt es an Langzeitdaten darüber, was tatsächlich wirkt. Viele KI-basierte Interventionen sind Pilotprojekte oder kommerzielle Produkte mit begrenzter Transparenz. Ohne unabhängige Evaluation und öffentlich zugängliche Daten ist es schwer zu beurteilen, ob diese Tools Schaden langfristig reduzieren oder das Problem nur auf andere Plattformen oder Bevölkerungsgruppen verlagern.

- Respektiert das Tool Privatsphäre? Werden Daten sicher gespeichert, und können Jugendliche es nutzen, ohne sensible Informationen preiszugeben?

- Ist die Sprache für alle Jugendlichen zugänglich? Vermeidet das Tool Fachjargon und berücksichtigt es Unterschiede in Alter, Hintergrund und digitaler Kompetenz?

- Gibt es Risiken, Stereotype zu verstärken? Erkennt das System vielfältige Identitäten und vermeidet es geschlechts-, rassismus- oder kulturbasierte Verzerrungen?

- Ist transparent, wie es funktioniert? Können Nutzer*innen nachvollziehen, wie Entscheidungen getroffen werden und was mit ihren Daten passiert?

- Wurde es mit Jugendbeteiligung entwickelt? Haben junge Menschen dieses Tool getestet oder mitgestaltet, damit es relevant und inklusiv ist?

| Ethische Herausforderung | Beschreibung | Auswirkung |

|---|---|---|

| Mangelnde Transparenz | Viele KI-Tools funktionieren als „Black Boxes“, sodass unklar bleibt, wie Entscheidungen getroffen werden | Betroffene könnten automatisierten Tools misstrauen oder nicht nachvollziehen, wie ihre Daten genutzt werden |

| Bias und Fehlklassifikation | KI kann gesellschaftliche Verzerrungen widerspiegeln und Gewalt gegen marginalisierte Nutzer*innen schlechter erkennen | NLP-Systeme können Hass gegen nicht-westliche Geschlechtsidentitäten übersehen |

| Überwachungsrisiken | Schutztools können ausgenutzt werden, um zu stalken oder zu missbrauchen | Standort-Tracking oder Emotions-Erkennung können gegen Betroffene eingesetzt werden |

| Fehlende Jugendbeteiligung im Design | Wenige KI-Tools werden gemeinsam mit jungen Menschen entwickelt, was zu Problemen bei Nutzbarkeit oder Sicherheit führen kann | Chatbots können lokalen Slang oder emotionale Nuancen übersehen, die für Jugendliche wichtig sind |

🛡️ Sichere Online-Praktiken

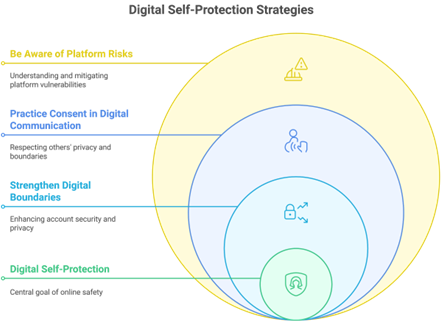

Diese Einheit stellt praxisnahe Strategien vor, um in digitalen Räumen sicherer zu agieren und im Kontext geschlechtsspezifischer Gewalt (GBV) sicherere Online-Erfahrungen zu unterstützen. Sie zeigt auf, wie Fachkräfte der Jugendarbeit das Risiko von Schäden verringern können, indem sie digitale Sicherheitsgewohnheiten stärken, wirksam auf Vorfälle von Online-Missbrauch reagieren und eine respektvolle, stärkende Kommunikation fördern. Außerdem beleuchtet die Einheit, wie positive Peer-Normen und das Handeln von Mitzeug*innen (Bystander) Online-Kulturen in Richtung mehr Sicherheit und Inklusion verändern können. Abschließend gibt sie Hinweise zur Nutzung plattformspezifischer Tools, um Missbrauch zu melden, Privatsphäre zu schützen und das psychische Wohlbefinden junger Menschen in digitalen Räumen zu unterstützen.

In einer zunehmend digitalen Welt ist der Schutz persönlicher Informationen und die Wahrung der Privatsphäre von zentraler Bedeutung. Dieser Abschnitt beschreibt grundlegende Strategien, mit denen Einzelpersonen ihren digitalen Selbstschutz verbessern können. Durch die Umsetzung dieser Kernstrategien können Nutzer*innen stärkere digitale Grenzen setzen, Einwilligung in ihrer Kommunikation praktizieren und sich der Risiken verschiedener Plattformen bewusster werden.

1. Digitale Grenzen stärken

- Starke, einzigartige Passwörter verwenden: Stelle sicher, dass alle wichtigen Konten mit komplexen Passwörtern geschützt sind, die nicht leicht zu erraten sind. Nutze ggf. einen Passwort-Manager, um sie zu verwalten.

- Zwei-Faktor-Authentifizierung aktivieren: Das schafft eine zusätzliche Sicherheitsebene, indem neben dem Passwort eine zweite Verifizierung (z. B. SMS oder Authenticator-App) erforderlich ist.

- Live-Standorte nicht teilen: Vermeide es, Echtzeit-Standorte oder sensible persönliche Daten in öffentlichen Foren zu posten, da dies unerwünschte Aufmerksamkeit oder Risiken erhöhen kann.

- Regelmäßige Privatsphäre-Checks durchführen: Überprüfe regelmäßig deine Privatsphäre-Einstellungen auf Social-Media-Plattformen, insbesondere Standortfreigaben, Markierungsberechtigungen und Follower-Listen, um sicherzustellen, dass deine Informationen nur für vertrauenswürdige Personen sichtbar sind.

2. Einwilligung in digitaler Kommunikation praktizieren

- Vor dem Teilen um Erlaubnis bitten: Frage immer nach Einwilligung, bevor du Bilder oder Videos teilst, auf denen andere Personen zu sehen sind. Das respektiert ihre Privatsphäre und Autonomie.

- Grenzen beim Nachrichtenversand respektieren: Bevor du sensiblen Inhalt in Gruppen-Chats oder Nachrichten weiterleitest, kläre mit der ursprünglichen sendenden Person, ob sie damit einverstanden ist.

- Gesunde Online-Beziehungen vorleben: Fördere positive Interaktionen, indem du manipulative Sprache oder Druck in deiner Kommunikation vermeidest und so ein respektvolles digitales Umfeld unterstützt.

3. Plattformrisiken kennen

- Risiken verschiedener Apps kennen: Mache dich damit vertraut, welche Anwendungen schwache Moderationsrichtlinien haben oder anonymen Missbrauch ermöglichen, da diese für Nutzer*innen besondere Risiken bergen können.

- Lernen, Inhalte zu verwalten: Verstehe, wie du auf großen Plattformen schädliche Inhalte blockieren, stummschalten oder melden kannst, um dein Online-Erleben zu schützen.

- Sicherheitsfunktionen nutzen: Nutze Sicherheitsfunktionen der Plattformen wie Keyword-Filter, Inhaltswarnungen und Begrenzungen für Follower (z. B. die Instagram-Funktion „Enge Freunde“), um deinen Online-Raum sicherer zu gestalten.

Durch die Anwendung dieser Strategien können Einzelpersonen ihren digitalen Selbstschutz deutlich verbessern und ein sichereres Online-Umfeld für sich selbst und andere fördern.

Lies jedes Szenario unten und wähle die passendste Handlung für eine*n Jugendarbeiter*in. Nachdem du gewählt hast, erscheinen die richtige Antwort und eine kurze Erklärung. Dies dient nur der Information—es werden keine Punkte gespeichert.

- DeRiggi, M., Henry, N., & Powell, A. (2023). Digital bystanders: What works to support victims of technology-facilitated GBV. Youth & Society. https://doi.org/10.1177/0044118X231163511

- Henry, N., & Powell, A. (2018). Technology-facilitated sexual violence: A literature review of empirical research. Trauma, Violence, & Abuse, 19(2), 195–208. https://doi.org/10.1177/1524838016650189

- Lippman, J. R., & Campbell, S. W. (2014). Damned if you do, damned if you don’t… if you’re a girl: Relational and normative contexts of adolescent sexting in the United States. Journal of Children and Media, 8(4), 371–386. https://doi.org/10.1080/17482798.2014.923009

- Musharu, T., Gomez, J. M., Rosales, M., & Navarro Soria, I. (2025, June). AI and open data for GBV prevention among youth: Ethical governance and policy frameworks in the EU. In Proceedings of the 14th BUIS-Tage Conference on Smart and Sustainable Infrastructures. Oldenburg, Germany.

- Powell, A., Henry, N., Flynn, A., & Sugiura, L. (2022). Online, always: A scoping review of technology-facilitated abuse and gender-based violence in the Global North. Computers in Human Behavior, 129, 107131. https://doi.org/10.1016/j.chb.2021.107131

- Rogers, M. M., Burke, J. G., & Earp, J. A. L. (2022). Technology-facilitated abuse in intimate relationships: A scoping review. Trauma, Violence, & Abuse, 24(4), 2210–2226. https://doi.org/10.1177/15248380221093133

- Stonard, K. E., Bowen, E., Lawrence, T. R., & Price, S. A. (2014). The relevance of technology to the nature, prevalence and impact of adolescent dating violence and abuse: A research synthesis. Aggression and Violent Behavior, 19(4), 390–417. https://doi.org/10.1016/j.avb.2014.06.005

- Umbach, R., Valdez, A., & Dobberstein, D. (2024). Non-consensual deepfake pornography: Evidence from ten countries. Proceedings of CHI ’24. https://doi.org/10.1145/3491102.3517575

- UNESCO. (2023). Exposing technology-facilitated gender-based violence in an era of generative AI. https://unesdoc.unesco.org/ark:/48223/pf0000386461

- UNICEF. (2022). Safer Chatbots: Implementation Guide. https://www.unicef.org/media/114681/file/Safer-Chatbots-Implementation-Guide-2022.pdf

- Wolak, J., Finkelhor, D., Mitchell, K. J., & Ybarra, M. L. (2008). Online “predators” and their victims: Myths, realities, and implications for prevention and treatment. American Psychologist, 63(2), 111–128. https://doi.org/10.1037/0003-066X.63.2.111