Modulo 6: Violenza di genere online e forme di violenza rese possibili dall’intelligenza artificiale

Ti diamo il benvenuto a questo modulo sulla violenza di genere online e sulle forme di violenza rese possibili dall’utilizzo dell’intelligenza artificiale. Questo modulo esplora le dinamiche della violenza di genere in rete ed esamina il duplice ruolo svolto dall’intelligenza artificiale, che può essere utilizzata sia per commettere tali violenze che per combatterle.

Panoramica del modulo

Ti diamo il benvenuto a questo modulo sulla violenza di genere online e sulle forme di violenza rese possibili dall’utilizzo dell’intelligenza artificiale.

Questo modulo esplora le dinamiche della violenza di genere in rete ed esamina il duplice ruolo svolto dall’intelligenza artificiale, che può essere utilizzata sia per commettere tali violenze che per combatterle.

Obiettivi di apprendimento del modulo

Al termine di questo modulo, sarai in grado di:

- Individuare le principali forme di violenza di genere online e le forme di violenza rese possibili dall’intelligenza artificiale.

- Comprendere il rapporto di continuità che lega le dinamiche della violenza online e offline e come gli abusi possono degenerare.

- Analizzare il duplice ruolo svolto dall’intelligenza artificiale nel perpetuare o mitigare la violenza di genere.

- Applicare alcune strategie volte a tutelare la sicurezza informatica e garantire un supporto nell’ambito dell’animazione socioeducativa.

💻 La violenza di genere online

Oggi Internet svolge un ruolo centrale nel modo in cui le persone giovani costruiscono legami, comunicano e vanno alla scoperta di loro stesse. Ma assieme a queste opportunità, gli spazi digitali presentano anche dei seri rischi, soprattutto per le ragazze, le giovani donne, chi si riconosce nella comunità LGBTIQA+ e in altri gruppi marginalizzati. La tecnologia non è neutra. Alle volte può essere un aiuto prezioso, ma può anche essere utilizzata per controllare, mettere alla berlina o fare del male.

Per violenza di genere online si intendono tutte quelle azioni violente, portate avanti attraverso le tecnologie digitali, che prendono di mira le persone sulla base del loro genere, della loro identità di genere o del loro orientamento sessuale. Secondo l’Istituto europeo per l’uguaglianza di genere (European Institute for Gender Equality – EIGE), oltre la metà delle giovani donne (52%) dell’Unione Europea ha subito questa forma di violenza, sotto forma di minacce, molestie o la condivisione non consensuale di immagini intime (EIGE, 2022). Lз giovani LGBTIQA+, appartenenti a minoranze etniche o con disabilità sono un bersaglio ancora più esposto.

Alcune forme di violenza di genere online hanno una grande visibilità, come i commenti d’odio o le immagini modificate. Altre sono nascoste o ritenute apparentemente “normali”, come il controllo dei messaggi da parte della o del partner o i tentativi di conquistare la fiducia di una persona al fine di commettere un abuso. Tuttavia, tutte le forme di violenza di genere online possono avere un profondo impatto sul piano emotivo, psicologico e fisico. Inoltre, spesso tali abusi si spostano dalla dimensione virtuale a quella reale.

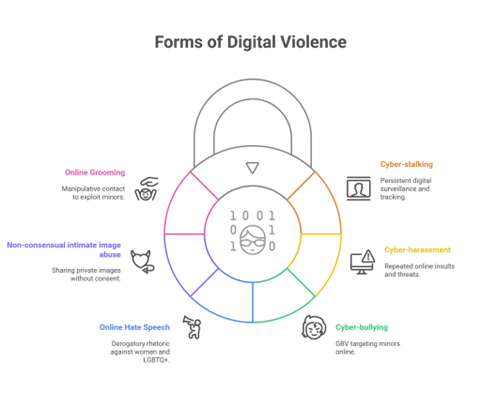

Questa sezione introduce le sette principali forme di violenza di genere online che le animatrici e gli animatori socioeducativi dovrebbero essere in grado di riconoscere. Ciascuna di queste forme di violenza viene illustrata con delle semplici definizioni e degli esempi tratti dalle piattaforme più popolari tra le persone giovani, quali WhatsApp, TikTok, Discord o Instagram. Riconoscere i segnali è il primo passo per prevenire eventuali danni e offrire sostegno.

1. Cyberstalking

L’utilizzo della tecnologia per monitorare le attività o la posizione di una persona senza il suo consenso. Tale forma di violenza si traduce nel tracciamento degli spostamenti di una persona attraverso applicazioni GPS come Snap Map, nel controllo ossessivo del suo status online o nella condivisione delle password per accedere a chat e messaggi privati.

Esempio: una ragazza continua ad essere controllata dal proprio ex che traccia la sua posizione su Snap Map, nonostante la loro relazione sia finita e la ragazza l’abbia bloccato su Instagram.

2. Molestie informatiche

Messaggi ripetuti e indesiderati, dal carattere aggressivo o minaccioso, a sfondo sessuale o umiliante, inviati attraverso messaggi privati, chat di gruppo o profili anonimi. I contenuti possono essere sempre più gravi.

Esempio: uno studente riceve una nota vocale da parte di un compagno di classe che lo insulta e minaccia di rivelare i suoi segreti.

3. Cyberbullismo

Il perpetuarsi di azioni caratterizzate da una particolare crudeltà ai danni di una persona minorenne, di solito portate avanti da parte del gruppo di pari. Tali azioni comprendono la creazione di meme, imitazioni, umiliazioni pubbliche o esclusione dagli spazi digitali (ad es., gruppi WhatsApp, storie private).

Esempio: un gruppo diffonde dei meme per prendere in giro il corpo di una compagna, taggandola nei commenti su TikTok.

4. Discorsi di odio online legati al genere

Espressioni di intolleranza minacciose e violente rivolte contro una persona per via del suo genere, del suo orientamento sessuale o della sua identità di genere. Spesso l’utilizzo di queste espressioni tende ad essere “normalizzato” e sminuito come una forma di ironia, meme o battute. Tuttavia, tali commenti possono avere delle pesanti ricadute sul piano psicologico.

Esempio: in un server Discord una persona giovane non binaria viene sempre chiamatǝ utilizzando dei marcatori di genere sbagliati e, nel momento in cui condivide i propri pronomi, viene insultatǝ.

5. Revenge porn o divulgazione non consensuale di immagini intime

Condividere o minacciare di condividere immagini o video intimi senza il consenso della persona interessata. Può trattarsi sia di foto reali che di contenuti prodotti utilizzando l’IA come i deepfake.

Esempio: una persona condivide una foto di nudo inviata in privato o crea un video deepfake e lo fa circolare su un forum anonimo.

6. Adescamento online

Avviene nel momento in cui un individuo costruisce volontariamente un rapporto di fiducia con una persona minorenne nel corso del tempo contattandola online al fine di manipolarla o di sfruttarla sessualmente. Chi adesca spesso finge di avere la stessa età oppure blandisce la persona con regali, attenzioni o complimenti.

Esempio: una ragazza di 14 anni che gioca ai videogiochi è invitata in una chat privata da qualcuno che le fa dei complimenti e poi le chiede di condividere foto e segreti.

Nota: spesso la vittima viene adescata con complimenti, mentre minacce e ricatti intervengono in un secondo momento. Le persone giovani potrebbero non rendersi conto di essere manipolate.

7. Doxxing o divulgazione non autorizzata di informazioni personali

La divulgazione pubblica dei dati personali di una persona (nome, indirizzo, numero di telefono, scuola frequentata) allo scopo di intimidire o incitare altri individui a prendere di mira la vittima. Spesso tale comportamento segue degli screzi online, oppure è diretto contro persone impegnate nel sociale o che condividono le proprie storie di coming out.

Esempio: dopo che una persona giovane condivide un post sui diritti delle persone LGBTIQA+ su TikTok, un troll decide di pubblicare il suo indirizzo di casa nei commenti.

La violenza di genere può assumere forme diverse, ma tutte possono avere un impatto sulla salute mentale, la fiducia, la sicurezza e la libertà della persona giovane. Chi si occupa di animazione socioeducativa o lavora nel mondo della scuola svolge un ruolo fondamentale al fine di riconoscere i segnali di allarme, creare un ambiente digitale sicuro e aiutare le persone giovani a individuare i comportamenti a rischio. La figura 1 riassume tutte le forme di violenza di genere online.

| Forma | Definizione | Esempi | Strategie per l’animazione socioeducativa | Scenario |

|---|---|---|---|---|

| Cyberstalking e sorveglianza digitale | Un controllo costante e indesiderato attraverso l’utilizzo di applicazioni per il monitoraggio, GPS o il controllo degli accessi per tenere traccia dei movimenti o delle attività online di una persona. | Rogers et al. (2022) individuano alcune tattiche comuni tra cui l’utilizzo di spyware, la condivisione di password e lo sfruttamento delle opportunità offerte da applicazioni come “Trova il mio dispositivo”. | Chiedere alle persone giovani se conoscono i pericoli rappresentati dalle applicazioni nascoste o dalla condivisione delle proprie credenziali. Promuovere un’analisi delle tecnologie e dei confini digitali. | Un’adolescente racconta che, nonostante abbia rotto con il suo ex, quest’ultimo conosce ancora i suoi spostamenti, sebbene abbia bloccato il suo contatto. |

| Molestie informatiche | Invio ripetuto di minacce, insulti o contenuti degradanti attraverso le piattaforme digitali. | Henry & Powell (2018) indicano che gli abusi online spesso simulano le stesse dinamiche della violenza intima tradizionale, soprattutto per quanto attiene alle rotture. | Aiutare le persone giovani a conservare le prove, segnalare i messaggi sulle piattaforme e a gestire le conseguenze negative. | Uno studente riceve giornalmente delle note vocali aggressive da parte di un compagno di classe nella chat di gruppo. |

| Cyberbullismo | Molestie o umiliazioni subite online da persone minorenni, spesso per mano di studenti che frequentano la loro stessa scuola o che hanno la loro stessa età. | Secondo Stonard et al. (2014) le tecnologie amplificano la portata del fenomeno del bullismo dal momento che non riguarda più solo l’ambiente scolastico, ma l’intera vita della persona. | Incoraggiare ad applicare delle regole di condotta tra pari; usare i giochi di ruolo per rafforzare l’empatia e le capacità di intervento. | Un gruppo di ragazze crea dei meme sul corpo di una compagna di classe e li condivide su Snapchat. |

| Discorsi di odio online relativi al genere | L’uso di una retorica aggressiva e volta a sminuire una persona per via del suo genere o della sua identità di genere. | Secondo Powell et al. (2022) le donne e le persone appartenenti alla comunità LGBTIQA+ subiscono dei discorsi d’odio caratterizzati da espressioni di intolleranza multiformi (ad es., una combinazione di sessismo e omofobia). | Preparare le persone giovani a riconoscere e a rispondere all’odio, non solo a ignorarlo e andare avanti. | Unǝ adolescente non binariǝ viene costantemente insultatǝ su un server Discord rivolto a persone appassionate di videogiochi. |

| Divulgazione non consensuale di immagini intime (revenge porn) | La condivisione di immagini o video intimi senza il consenso della persona ritratta. Le vittime di queste azioni sono spesso ex-partner o persone appartenenti al gruppo di pari. | Lippman & Campbell (2014) hanno dimostrato che spesso le e gli adolescenti subiscono delle pressioni per inviare immagini di nudo che, spesso, vengono ricondivise senza il loro consenso. | Insegnare alle persone giovani quali sono i loro diritti, far comprendere loro il concetto di consenso e le conseguenze emotive legate alla condivisione di immagini intime. | Un ragazzo minaccia di postare le foto della sua ex se non acconsente a parlargli di nuovo. |

| Adescamento online | Un insieme di comportamenti volti a manipolare una persona minorenne per spingerla a fidarsi o a sviluppare un rapporto di dipendenza allo scopo di ottenere dei favori sessuali. | Secondo Wolak et al. (2008), la maggior parte dei casi di adescamento online comincia con dei complimenti e si trasforma pian piano in manipolazione. | Sottolineare che chi commette gli abusi non si limita solo a costruire un rapporto di fiducia, ma utilizza anche delle minacce; lavorare anche sull’alfabetizzazione mediatica. | Un ragazzo di 15 anni viene invitato in una chat privata da una persona sconosciuta che gli promette delle ricompense nel corso del gioco. |

🤖 Il ruolo dell’intelligenza artificiale nell’ambito della violenza di genere

L’intelligenza artificiale sta cambiando il nostro modo di comunicare, interagire e accedere alle informazioni, soprattutto all’interno degli spazi digitali in cui le persone giovani trascorrono molto tempo. Tuttavia, a dispetto dei suoi benefici, l’intelligenza artificiale sta trasformando anche il modo di commettere reati come la violenza di genere.

Questa unità prende in esame il modo in cui l’intelligenza artificiale può essere utilizzata allo scopo di facilitare gli abusi o di supportare le iniziative di prevenzione e contrasto alla violenza di genere. Offre degli spunti pratici a chi si occupa di animazione socioeducativa o insegna nelle scuole affinché possa familiarizzare con gli strumenti, i rischi e le opportunità rappresentate dall’intelligenza artificiale.

L’unità sottolinea, inoltre, i dilemmi etici legati all’utilizzo di sistemi automatici in contesti delicati quali l’assistenza psicologica e riflette sui limiti degli attuali approcci adottati ai fini della progettazione degli strumenti di intelligenza artificiale, in particolare di quelli che non sfruttano gli spunti forniti dalle persone giovani o dalle comunità emarginate.

Inoltre, le forme di violenza di genere rese possibili dai sistemi di intelligenza artificiale non dovrebbero essere ritenute un fenomeno completamente nuovo. Si tratta, infatti, semplicemente dell’utilizzo di nuovi canali digitali al fine di perpetrare la violenza. La violenza di genere si consuma senza soluzione di continuità sia online che offline, dal momento che molte delle minacce che vediamo adesso in rete, quali i meccanismi di sorveglianza, coercizione o la diffusione non consensuale di immagini intime, rispecchiano le dinamiche di potere e controllo presenti nella vita di tutti i giorni. Non è stata la tecnologia a inventare questi comportamenti, ma li ha però amplificati, automatizzati e diffusi, spesso in un modo tale da renderli difficili da individuare o da affrontare.

L’intelligenza artificiale può essere uno strumento potente, ma come molte tecnologie viene anche utilizzata in maniera scorretta. L’intelligenza artificiale, infatti, ha fornito ai perpetratori di violenza di genere nuovi metodi per molestare, umiliare e controllare le vittime, in particolare negli spazi digitali in cui le persone giovani sono più attive.

Uno degli impieghi più disturbanti è il ricorso ai deepfake, immagini o video generati dall’intelligenza artificiale che consentono di aggiungere il volto di una persona a una scena pornografica senza il suo consenso. Questi video vengono spesso condivisi sui social media o attraverso applicazioni di messaggistica crittografate. Sebbene tali immagini siano false, le vittime, spesso ragazze o giovani donne o giovani appartenenti alla comunità LGBTIQA+, dichiarano di sentirsi umiliate, spaventate e socialmente isolate (Umbach et al., 2024).

Un altro cattivo utilizzo dell’intelligenza artificiale consiste nella creazione di bot programmati per mandare messaggi violenti, umilianti o minacciosi. Tali bot prendono di mira attivistз, influencer o chiunque affronti pubblicamente tematiche inerenti al genere, alla sessualità o alla giustizia sociale. L’enorme volume di messaggi può far apparire l’abuso inarrestabile, un meccanismo a cui è impossibile sfuggire (Powell et al., 2022).

L’intelligenza artificiale può fare del male anche indirettamente. Gli algoritmi delle piattaforme tendono a dare la priorità a contenuti in grado di garantire un engagement elevato e, quindi, a promuovere i post che suscitano rabbia o indignazione. Ciò significa che i contenuti misogini o transfobici riescono a raggiungere più persone, non perché le piattaforme desiderino promuoverli attivamente, ma perché i sistemi di intelligenza artificiale sono progettati per ottimizzare l’attenzione, non la sicurezza (Henry & Powell, 2018).

Infine, le tecnologie che si servono dell’intelligenza artificiale, utilizzate nelle case intelligenti, nei dispositivi indossabili o nelle applicazioni per monitorare la salute mentale, possono trasformarsi in strumenti di sorveglianza. L’abusante potrebbe servirsi di questi sistemi per monitorare la posizione della vittima, accedere ai suoi messaggi privati o interpretarne gli stati d’animo senza il suo consenso. La vittima, inoltre, potrebbe non essere consapevole di essere sorvegliata a distanza (Powell et al., 2022).

Tali rischi ci consentono di comprendere un messaggio fondamentale: l’intelligenza artificiale non causa gli abusi, ma può essere sfruttata da chi ha delle cattive intenzioni. È essenziale, dunque, che chi si occupa di animazione socioeducativa, istruzione e servizi sociali comprenda come funzionano queste tecnologie e come si ricollegano alle dinamiche della violenza online, al fine di proteggere e fornire alle persone giovani gli strumenti necessari per contrastarle, come riportato nella tabella 2.

| Metodo | Descrizione | Esempio concreto | Riferimento |

|---|---|---|---|

| Deepfake | Immagini o video generati dall’intelligenza artificiale in grado di sostituire il volto di qualcuno su dei contenuti pornografici. | Un’adolescente scopre un video pornografico in cui si vede il suo volto, realizzato grazie alla tecnica del deepfake. | Umbach et al. (2024) |

| Bot-molestatori | Profili automatici che spammano contenuti violenti o degradanti, spesso prendendo di mira persone che fanno attivismo o che appartengono a gruppi marginalizzati. | Dopo un suo intervento pubblico, una giovane attivista per il clima riceve centinaia di messaggi di insulti prodotti con l’intelligenza artificiale su tutte le piattaforme. | Powell et al. (2022) |

| Amplificazione algoritmica dei messaggi di odio | Gli algoritmi delle piattaforme danno la priorità ai discorsi d’odio o ai post provocatori al fine di aumentare l’engagement, esponendo il gruppo target ad abusi. | Un gruppo di influencer LGBTIQA+ denuncia un aumento dei messaggi d’odio ricevuti dopo aver condiviso un post sul pride. | Henry & Powell (2018) |

| Sfruttamento dei dati personali | I sistemi di intelligenza artificiale divulgano dati personali attraverso i dispositivi “intelligenti” o trasmettono informazioni sensibili senza il consenso dell’utente. | Un altoparlante intelligente in casa di un’adolescente registra un litigio privato e trasmette gli audio al server senza il consenso dell’utente. | Powell et al. (2022) |

Benché i sistemi di intelligenza artificiale possano essere utilizzati per scopi malevoli, essi possono anche essere utili al fine di prevenire, individuare tempestivamente e sostenere le vittime di violenza di genere. Se sviluppata e utilizzata in maniera etica, l’intelligenza artificiale può migliorare la sicurezza e ampliare l’accesso ai servizi di supporto per le persone vittime di abusi online.

L’intelligenza artificiale può essere utilizzata efficacemente al fine di riconoscere e rimuovere i contenuti pericolosi. Strumenti che usano il riconoscimento delle immagini, come quelli creati sul modello di PhotoDNA di Microsoft, possono già aiutare le piattaforme a individuare e bloccare la pubblicazione di materiale pedopornografico. Tali sistemi confrontano le immagini caricate con altri contenuti segnalati in precedenza. Sebbene questi strumenti non possano impedire che siano create altre immagini, costituiscono un meccanismo di tutela importante rispetto alla diffusione di materiale violento (UNICEF, 2022).

L’intelligenza artificiale, inoltre, può essere adoperata per far funzionare chatbot e assistenti virtuali in grado di aiutare le persone sopravvissute a violenza a trovare il sostegno di cui hanno bisogno. Questi strumenti sono particolarmente utili alle persone giovani che potrebbero non avere la sicurezza necessaria per parlare con qualcuno di persona. I chatbot possono aiutare l’utenza ponendo delle domande riguardo alle esperienze vissute e mettendo le persone in contatto con figure professionali che operano nel campo dei servizi di salute mentale, dell’assistenza legale o di risposta alle emergenze. Quando tali chatbot sono progettati tenendo conto delle conseguenze derivanti dalle esperienze traumatiche e sono disponibili in più lingue, possono fornire un primo contatto sicuro prima di passare a forme di supporto più concreto (Musharu et al., 2025).

I sistemi di elaborazione del linguaggio naturale (Natural Language Processing, NLP) costituiscono una forma di intelligenza artificiale in grado di aiutare i computer a comprendere il linguaggio umano. Sono utilizzati per individuare e bloccare i discorsi d’odio. Piattaforme come X (ex-Twitter), Instagram e TikTok si servono sempre più di questi modelli per esaminare i post al fine di individuare ed eliminare i messaggi scritti con un linguaggio minaccioso e violento. Benché tali strumenti non siano perfetti, aiutano a contenere i danni e possono proteggere le persone dagli effetti psicologici delle molestie mirate (Powell et al., 2022).

Si sta tentando, inoltre, di utilizzare l’intelligenza artificiale nei sistemi di prevenzione e segnalazione. Alcune applicazioni analizzano elementi del comportamento dell’utente, quali il tono dei messaggi e la frequenza dei contatti, per individuare dei pattern a rischio. L’utilizzo degli strumenti dell’intelligenza artificiale è stato preso in considerazione per affrontare i casi di violenza domestica e per evitare situazioni ad alto rischio, impedendo, di fatto, che si consumino le violenze. Tali modelli predittivi devono essere impiegati con cura per evitare dei falsi positivi o violazioni della privacy, ma sembrano promettenti al fine di migliorare la tempestività degli interventi (Henry & Powell, 2018).

Ciò che rende utili questi strumenti non è la tecnologia con cui sono stati creati, bensì il modo in cui essi sono introdotti, spiegati e utilizzati. Gli strumenti co-progettati con l’aiuto di persone giovani, sopravvissute a violenza e organizzazioni dal basso hanno maggiori possibilità di riflettere le reali esigenze delle persone che, dunque, potranno affidarsi ad essi con maggiore facilità (cfr. tabella 3).

| Applicazione di IA | Descrizione | Esempio | Riferimento |

|---|---|---|---|

| Strumenti per il riconoscimento delle immagini | Gli strumenti di intelligenza artificiale riescono a individuare contenuti che sono riconducibili ad abusi noti o sospetti (ad es., immagini di nudo condivise in maniera non consensuale), segnalarli/rimuoverli dalle piattaforme. | Meta si serve di uno strumento progettato sul modello di PhotoDNA per bloccare il caricamento di materiale pedopornografico. | UNICEF (2022) |

| Chatbot di monitoraggio | I bot che funzionano grazie a sistemi di intelligenza artificiale guidano le persone sopravvissute nell’individuazione del servizio più adatto a loro, 24/7, basandosi sui principi di un’assistenza psicologica attenta alle conseguenze derivanti dalle esperienze traumatiche. | Un giovane accede a un chatbot su WhatsApp per trovare un servizio di tutela della salute mentale nella propria lingua. | Musharu et al. (2025) |

| NLP per individuare i discorsi d’odio | I sistemi di elaborazione del linguaggio naturale (NLP) sono utilizzati per segnalare automaticamente i post misogini e transfobici. | Twitter impiegava strumenti in grado di categorizzare i contenuti sulla base di dati relativi ai discorsi d’odio. | Powell et al. (2022) |

| Controllo predittivo e segnalazioni rapide | L’intelligenza artificiale è utilizzata in via sperimentale per analizzare i comportamenti a rischio al fine di prevenire le violenze oppure attivare i sistemi di segnalazione. | Alcune applicazioni sperimentali valutano il rischio di escalation nei casi di violenza domestica analizzando il tono e la frequenza dei messaggi. | Henry & Powell (2018) |

Dal momento che i sistemi di intelligenza artificiale sono utilizzati nel contrasto alla violenza di genere, è essenziale comprenderne non solo le capacità, ma anche i rischi e i limiti. Gli strumenti di intelligenza artificiale, infatti, non sono neutri. Sono creati sulla base dei dati che vengono utilizzati per allenarli, degli obiettivi di chi li sviluppa e del contesto sociale in cui sono impiegati. Senza un’opportuna supervisione, questi strumenti possono rafforzare le disuguaglianze, esporre le persone sopravvissute a nuove forme di violenza o non riuscire a proteggere i soggetti per i quali sono stati progettati.

Una delle principali preoccupazioni è costituita dalla presenza di bias nei modelli di intelligenza artificiale. Molti sistemi utilizzati per riconoscere i discorsi d’odio, i messaggi violenti o le immagini pericolose sono allenati sulla base dei dati a disposizione, per cui potrebbe capitare che determinati gruppi o lingue siano sottorappresentati. Di conseguenza, gli abusi rivolti alle donne di colore, a individui appartenenti alla comunità LGBTIQA+ o a persone non occidentali potrebbero non essere riconosciuti. In alcuni casi la legittima espressione di rabbia o frustrazione da parte delle persone sopravvissute viene segnalata per errore come violenta, mentre le vere minacce continuano a rimanere online (Powell et al., 2022).

Un altro rischio è rappresentato dalla mancanza di trasparenza rispetto al modo in cui i sistemi di intelligenza artificiale prendono decisioni. Le persone sopravvissute potrebbero non sapere per quale ragione un post viene eliminato oppure perché un chatbot ha fornito una determinata risposta. Il problema dell’opacità (in inglese black box problem) riduce la fiducia nei confronti dei sistemi di intelligenza artificiale e ne limita l’affidabilità. Ciò può generare confusione o frustrazione tra le persone giovani che hanno meno familiarità con i diritti digitali quando cercano aiuto in rete (Henry & Powell, 2018).

Il cattivo utilizzo dei sistemi di sorveglianza costituisce un altro problema. Gli strumenti di intelligenza artificiale progettati per proteggere le persone, come sistemi di tracciamento della posizione o programmi per il riconoscimento degli stati emotivi, possono essere sfruttati da chi commette gli abusi. Se tali applicazioni non sono dotate di sistemi per la protezione della privacy stringenti, possono essere adoperate per monitorare o controllare le vittime, anziché per aiutarle. Tutto ciò è particolarmente pericoloso nei casi di violenza domestica, in quanto le nuove tecnologie possono entrare a far parte di un meccanismo di controllo coercitivo (UNESCO, 2023).

La scarsa partecipazione delle persone giovani alla progettazione di questi strumenti rappresenta un altro forte limite. Le persone giovani spesso vivono esperienze di abusi online uniche, ma raramente vengono consultate nello sviluppo di soluzioni per la sicurezza digitale. Tutto questo può tradursi in strumenti che non sono adatti alle loro esigenze, adoperano un linguaggio poco chiaro oppure non tengono conto di importanti elementi contestuali, quali slang, norme culturali o rischi insiti all’architettura delle piattaforme (Musharu et al., 2025).

Infine, mancano dati longitudinali che consentano di valutare l’effettivo funzionamento dei sistemi di intelligenza artificiale. Molti interventi, infatti, sono collegati a progetti sperimentali o prodotti commerciali poco trasparenti. Senza una valutazione indipendente e dati di pubblico dominio è difficile comprendere se questi strumenti consentono davvero di ridurre i rischi nel corso del tempo o se, semplicemente, trasferiscono il problema su altre piattaforme o ad altri segmenti di popolazione.

- Lo strumento rispetta la privacy? I dati sono archiviati in modo sicuro e le persone giovani possono servirsene senza condividere informazioni sensibili?

- Il linguaggio utilizzato è accessibile? Lo strumento evita il gergo tecnico e tiene conto delle differenze relative all’età, al background culturale e al livello di alfabetizzazione digitale?

- Esistono rischi di rafforzare stereotipi? Il sistema riconosce le diverse identità ed evita i pregiudizi di genere, razziali o culturali?

- Il funzionamento dell’applicazione è chiaro e trasparente? Chi se ne serve può comprendere come vengono prese le decisioni e cosa succede ai dati personali?

- Lo strumento è stato progettato con il contributo delle persone giovani? Le persone giovani hanno testato o aiutato a progettare questo strumento affinché fosse utile e inclusivo?

| Questione etica | Descrizione | Implicazioni |

|---|---|---|

| Mancanza di trasparenza | Molti strumenti di intelligenza artificiale sono poco trasparenti, dal momento che risultano poco chiari i meccanismi decisionali. | Le persone sopravvissute potrebbero non fidarsi degli strumenti automatizzati o non riuscire a comprendere il modo in cui i loro dati sono utilizzati. |

| Bias e problemi di categorizzazione | L’intelligenza artificiale potrebbe riflettere i pregiudizi della società, non riuscendo a individuare gli abusi nei confronti di persone marginalizzate. | I sistemi di elaborazione del linguaggio naturale possono non riconoscere le espressioni d’odio rivolte contro persone con identità di genere non occidentali. |

| Rischi legati alla sorveglianza | Strumenti pensati per offrire protezione possono essere sfruttati per tenere sotto controllo la vittima o per commettere abusi. | Il monitoraggio della posizione o gli strumenti volti a riconoscere gli stati emotivi possono essere sfruttati a danno delle vittime. |

| Mancanza del punto di vista delle persone giovani | Pochi strumenti di intelligenza artificiale sono co-progettati con la collaborazione delle persone giovani, creando un’incompatibilità tra sicurezza e possibilità di utilizzo. | I chatbot potrebbero non riconoscere alcune espressioni gergali o sfumature emotive importanti per le persone giovani. |

🛡️ Strategie per tutelare la propria sicurezza online

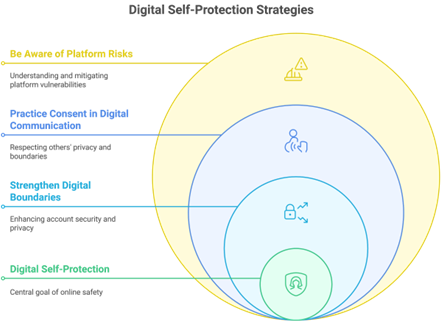

Questa unità presenta alcune strategie pratiche per navigare in rete in modo sicuro senza subire violenza di genere. Prende in esame il modo in cui chi si occupa di animazione socioeducativa può aiutare a ridurre i rischi legati alla violenza di genere online rafforzando le abitudini legate alla sicurezza digitale, rispondendo efficacemente e incoraggiando una comunicazione rispettosa e in grado di contribuire all’empowerment delle persone. L’unità mostra, inoltre, quanto l’esempio positivo del gruppo di pari e le azioni dei testimoni possano trasformare le culture digitali al fine di garantire una maggiore sicurezza e inclusione. Infine, fornisce delle indicazioni sull’uso di piattaforme specifiche per denunciare gli abusi, tutelare la privacy e sostenere il benessere mentale delle persone giovani negli spazi digitali.

In un mondo sempre più digitale, tutelare le proprie informazioni personali e la propria privacy costituisce un imperativo fondamentale. Questa sezione delinea le strategie che le persone devono adottare allo scopo di proteggersi al meglio quando navigano su Internet. Adottando queste strategie ogni utente può creare dei confini digitali solidi, riconoscere l’importanza del consenso nelle proprie comunicazioni online ed essere consapevole dei rischi associati a ciascuna piattaforma.

1. Rafforzare i confini digitali

- Utilizzare password forti e diverse tra loro: assicurarsi che tutti gli account principali siano protetti con password complesse che non possono essere violate facilmente. È consigliabile utilizzare un sistema di gestione delle password per tenerne traccia.

- Attivare l’autenticazione a due fattori: ciò aggiunge un ulteriore livello di sicurezza ai propri account in quanto richiede una seconda modalità di verifica dell’identità, ad esempio tramite un messaggio di testo o un’app di autenticazione.

- Evitare di condividere la propria posizione in tempo reale: astenersi dal condividere la propria posizione o dati sensibili su forum pubblici, poiché ciò può suscitare attenzioni indesiderate o esporre ad ulteriori rischi.

- Controllare regolarmente le impostazioni relative alla privacy: rivedere periodicamente le impostazioni di privacy sui social media, concentrandosi sulla condivisione della posizione, i permessi relativi ai tag e l’elenco di follower, per assicurarsi che solo persone fidate possano accedere ai dati personali.

2. Essere consapevoli dell’importanza del consenso nelle comunicazioni digitali

- Chiedere il permesso prima di condividere contenuti: bisogna sempre chiedere il permesso prima di condividere immagini o video che raffigurano altre persone. In questo modo è possibile rispettare la loro privacy e il loro diritto all’autodeterminazione.

- Rispettare i limiti nella messaggistica: prima di inoltrare un contenuto sensibile all’interno di una chat di gruppo o tramite messaggi privati, è opportuno chiedere il permesso alla persona che ha inviato il contenuto per assicurarsi che sia d’accordo con la condivisione.

- Essere un esempio e mantenere relazioni sane online: promuovere interazioni positive evitando di utilizzare un linguaggio manipolatorio o pressioni, così da contribuire a creare un ambiente digitale improntato al rispetto.

3. Essere consapevoli dei rischi rappresentati dalle piattaforme

- Conoscere i rischi delle varie app: saper riconoscere le applicazioni che hanno meccanismi di moderazione deboli o che tollerano gli abusi da parte di utenti anonimi, perché possono rappresentare un rischio significativo.

- Imparare a gestire i contenuti: sapere come bloccare, silenziare o segnalare i contenuti pericolosi presenti sulle principali piattaforme per proteggere la propria esperienza online.

- Utilizzare le impostazioni di sicurezza: sfruttare gli strumenti per la sicurezza offerti dalle piattaforme, quali filtri per le parole chiave, avvisi sui contenuti sensibili e limiti ai follower (ad esempio, utilizzando l’opzione “Amici più stretti” su Instagram) allo scopo di creare spazi online più sicuri.

Adottando queste strategie, le persone possono migliorare il loro livello di protezione in rete e contribuire a creare un ambiente online più sicuro per loro stesse e per gli altri.

Leggi ogni scenario qui sotto e scegli l’azione più appropriata per la/il professionista dell’animazione socioeducativa. Dopo la scelta, apparirà la risposta corretta con una breve spiegazione. Si tratta di un’attività puramente informativa: non vengono salvati punteggi.

- DeRiggi, M., Henry, N., & Powell, A. (2023). Digital bystanders: What works to support victims of technology-facilitated GBV. Youth & Society. https://doi.org/10.1177/0044118X231163511

- Henry, N., & Powell, A. (2018). Technology-facilitated sexual violence: A literature review of empirical research. Trauma, Violence, & Abuse, 19(2), 195–208. https://doi.org/10.1177/1524838016650189

- Lippman, J. R., & Campbell, S. W. (2014). Damned if you do, damned if you don’t… if you’re a girl: Relational and normative contexts of adolescent sexting in the United States. Journal of Children and Media, 8(4), 371–386. https://doi.org/10.1080/17482798.2014.923009

- Musharu, T., Gomez, J. M., Rosales, M., & Navarro Soria, I. (2025, June). AI and open data for GBV prevention among youth: Ethical governance and policy frameworks in the EU. In Proceedings of the 14th BUIS-Tage Conference on Smart and Sustainable Infrastructures. Oldenburg, Germany.

- Powell, A., Henry, N., Flynn, A., & Sugiura, L. (2022). Online, always: A scoping review of technology-facilitated abuse and gender-based violence in the Global North. Computers in Human Behavior, 129, 107131. https://doi.org/10.1016/j.chb.2021.107131

- Rogers, M. M., Burke, J. G., & Earp, J. A. L. (2022). Technology-facilitated abuse in intimate relationships: A scoping review. Trauma, Violence, & Abuse, 24(4), 2210–2226. https://doi.org/10.1177/15248380221093133

- Stonard, K. E., Bowen, E., Lawrence, T. R., & Price, S. A. (2014). The relevance of technology to the nature, prevalence and impact of adolescent dating violence and abuse: A research synthesis. Aggression and Violent Behavior, 19(4), 390–417. https://doi.org/10.1016/j.avb.2014.06.005

- Umbach, R., Valdez, A., & Dobberstein, D. (2024). Non-consensual deepfake pornography: Evidence from ten countries. Proceedings of CHI ’24. https://doi.org/10.1145/3491102.3517575

- UNESCO. (2023). Exposing technology-facilitated gender-based violence in an era of generative AI. https://unesdoc.unesco.org/ark:/48223/pf0000386461

- UNICEF. (2022). Safer Chatbots: Implementation Guide. https://www.unicef.org/media/114681/file/Safer-Chatbots-Implementation-Guide-2022.pdf

- Wolak, J., Finkelhor, D., Mitchell, K. J., & Ybarra, M. L. (2008). Online “predators” and their victims: Myths, realities, and implications for prevention and treatment. American Psychologist, 63(2), 111–128. https://doi.org/10.1037/0003-066X.63.2.111