Ενότητα 6: Διαδικτυακή και Υποβοηθούμενη από ΤΝ Έμφυλη Βία

Διερεύνηση του τρόπου με τον οποίο η έμφυλη βία εκδηλώνεται σε ψηφιακούς χώρους και πώς η Τεχνητή Νοημοσύνη μπορεί τόσο να ενισχύσει όσο και να συμβάλει στην πρόληψη της βλάβης.

Επισκόπηση Κεφαλαίου

Καλώς ήρθατε σε αυτή την ενότητα για τη Διαδικτυακή και Υποβοηθούμενη από ΤΝ Έμφυλη Βία. Η ενότητα αυτή εξετάζει τους τρόπους με τους οποίους η έμφυλη βία (GBV) εκδηλώνεται σε διαδικτυακούς χώρους και αναλύει τον διττό ρόλο της Τεχνητής Νοημοσύνης (ΤΝ) τόσο στη διευκόλυνση όσο και στην αντιμετώπιση αυτών των μορφών βίας.

Μαθησιακοί Στόχοι Κεφαλαίου

Με την ολοκλήρωση αυτής της ενότητας, θα μπορείτε να:

- Αναγνωρίζετε τις βασικές μορφές διαδικτυακής και υποβοηθούμενης από ΤΝ έμφυλης βίας.

- Κατανοείτε τη συνέχεια μεταξύ διαδικτυακής και εκτός διαδικτύου βίας και πώς η κακοποίηση μπορεί να κλιμακωθεί.

- Αναλύετε τον διττό ρόλο της ΤΝ στη διαιώνιση και στον μετριασμό της έμφυλης βίας.

- Εφαρμόζετε στρατηγικές για ψηφιακή ασφάλεια και υποστήριξη στο πλαίσιο της εργασίας με νέους.

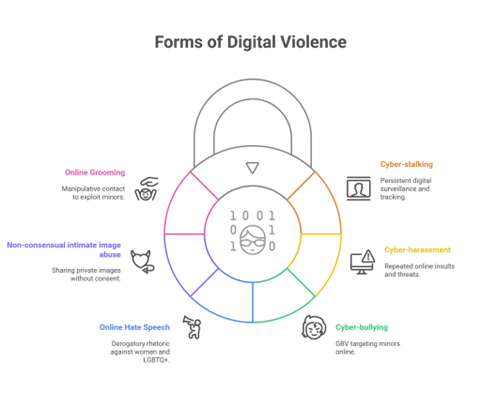

💻 Μορφές Διαδικτυακής Έμφυλης Βίας

Στον σημερινό ψηφιακό κόσμο, το διαδίκτυο αποτελεί κεντρικό στοιχείο στον τρόπο με τον οποίο οι νέοι συνδέονται, επικοινωνούν και εξερευνούν την ταυτότητά τους. Ωστόσο, μαζί με αυτές τις ευκαιρίες, οι ψηφιακοί χώροι ενέχουν και σοβαρούς κινδύνους—ιδίως για κορίτσια, νεαρές γυναίκες, ΛΟΑΤΚΙ+ νέους και άλλες περιθωριοποιημένες ομάδες. Η τεχνολογία δεν είναι ουδέτερη. Μπορεί να χρησιμοποιηθεί για υποστήριξη, αλλά και για έλεγχο, διαπόμπευση ή πρόκληση βλάβης.

Η διαδικτυακή έμφυλη βία (GBV) αναφέρεται σε επιβλαβείς ενέργειες που πραγματοποιούνται μέσω ψηφιακών τεχνολογιών και στοχεύουν άτομα λόγω του φύλου, της ταυτότητας φύλου ή του σεξουαλικού τους προσανατολισμού. Σύμφωνα με το Ευρωπαϊκό Ινστιτούτο για την Ισότητα των Φύλων (EIGE), πάνω από τις μισές νεαρές γυναίκες (52%) στην ΕΕ έχουν βιώσει κάποια μορφή διαδικτυακής βίας—συμπεριλαμβανομένων απειλών, παρενόχλησης και μη συναινετικής κοινοποίησης προσωπικών εικόνων (EIGE, 2022). Οι ΛΟΑΤΚΙ+ νέοι, οι φυλετικές μειονότητες και οι νέοι με αναπηρίες στοχοποιούνται επίσης δυσανάλογα.

Ορισμένες μορφές διαδικτυακής έμφυλης βίας είναι έντονες και δημόσιες, όπως τα μισαλλόδοξα σχόλια ή οι παραποιημένες εικόνες. Άλλες είναι πιο κρυφές ή παρουσιάζονται ως «φυσιολογικές», όπως τα ελεγκτικά μηνύματα μέσα σε μια σχέση ή όταν ένας άγνωστος χτίζει εμπιστοσύνη στο διαδίκτυο με σκοπό την κακοποίηση. Όλες όμως οι μορφές διαδικτυακής έμφυλης βίας μπορούν να έχουν σοβαρές συναισθηματικές, ψυχολογικές και ακόμη και σωματικές επιπτώσεις. Μπορούν να κλιμακωθούν εκτός διαδικτύου—και συχνά αυτό συμβαίνει.

Η ενότητα αυτή παρουσιάζει επτά βασικές μορφές διαδικτυακής έμφυλης βίας που οι επαγγελματίες νεολαίας και οι εκπαιδευτικοί θα πρέπει να μπορούν να αναγνωρίζουν. Κάθε μορφή εξηγείται με απλούς ορισμούς και συγκεκριμένα παραδείγματα από πλατφόρμες που χρησιμοποιούν οι νέοι—όπως το WhatsApp, το TikTok, το Discord ή το Instagram. Η αναγνώριση των ενδείξεων είναι το πρώτο βήμα για την πρόληψη της βλάβης και την παροχή υποστήριξης.

1. Κυβερνοπαρακολούθηση (Cyber-stalking)

Χρήση ψηφιακών εργαλείων για την παρακολούθηση της δραστηριότητας ή της τοποθεσίας κάποιου χωρίς συναίνεση. Μπορεί να περιλαμβάνει παρακολούθηση μέσω εφαρμογών GPS όπως το Snap Map, εμμονικό έλεγχο της διαδικτυακής κατάστασης ή χρήση κοινόχρηστων κωδικών για πρόσβαση σε μηνύματα.

Παράδειγμα: Ο/η πρώην σύντροφος μιας έφηβης συνεχίζει να παρακολουθεί την τοποθεσία της στο Snap Map ακόμη και αφού εκείνη τερματίσει τη σχέση και τον/την μπλοκάρει στο Instagram.

2. Κυβερνοπαρενόχληση (Cyber-harassment)

Επαναλαμβανόμενα, ανεπιθύμητα μηνύματα που είναι επιθετικά, απειλητικά, σεξουαλικά ή εξευτελιστικά. Συχνά συμβαίνει σε ιδιωτικά μηνύματα, ομαδικές συνομιλίες ή μέσω ανώνυμων λογαριασμών και μπορεί να κλιμακωθεί γρήγορα.

Παράδειγμα: Μαθητής/μαθήτρια λαμβάνει καθημερινά ηχητικά μηνύματα από συμμαθητή/τρια που τον/την αποκαλεί με προσβλητικά ονόματα και απειλεί να αποκαλύψει προσωπικά μυστικά.

3. Διαδικτυακός εκφοβισμός (Cyber-bullying)

Πρότυπο στοχευμένης διαδικτυακής σκληρότητας απέναντι σε ανήλικο άτομο, συνήθως από συνομηλίκους. Μπορεί να περιλαμβάνει memes, πλαστοπροσωπία, δημόσια διαπόμπευση ή αποκλεισμό από ψηφιακούς χώρους (π.χ. ομάδες WhatsApp, ιδιωτικά stories).

Παράδειγμα: Μια ομάδα διαδίδει ένα επεξεργασμένο meme για το σώμα μιας συμμαθήτριας, επισημαίνοντάς την σε σχόλια στο TikTok.

4. Διαδικτυακός έμφυλος λόγος μίσους

Κακοποιητική ή απειλητική γλώσσα που στρέφεται εναντίον κάποιου λόγω του φύλου, του σεξουαλικού προσανατολισμού ή της ταυτότητάς του. Συχνά «κανονικοποιείται» μέσα από ειρωνεία, memes ή «αστεία», αλλά είναι βαθιά επιβλαβής.

Παράδειγμα: Μη δυαδικό άτομο δέχεται επανειλημμένα λανθασμένη προσφώνηση σε server στο Discord και του λένε «να αυτοκτονήσει» αφού μοιραστεί τις αντωνυμίες του.

5. Μη συναινετική κοινοποίηση προσωπικού υλικού (συχνά αποκαλείται «εκδικητική πορνογραφία»)

Κοινοποίηση ή απειλή κοινοποίησης προσωπικών φωτογραφιών ή βίντεο χωρίς τη συναίνεση του ατόμου. Περιλαμβάνει πραγματικές εικόνες αλλά και περιεχόμενο που έχει παραποιηθεί με ΤΝ, όπως deepfakes.

Παράδειγμα: Κάποιος διαρρέει γυμνή φωτογραφία που στάλθηκε εμπιστευτικά ή δημιουργεί deepfake βίντεο και το διακινεί σε ανώνυμα φόρουμ.

6. Διαδικτυακή αποπλάνηση ανηλίκου (Online grooming)

Όταν κάποιος χτίζει σκόπιμα σχέση εμπιστοσύνης με ανήλικο άτομο μέσω διαδικτύου, με σκοπό να το χειραγωγήσει ή να το εκμεταλλευτεί σεξουαλικά. Οι δράστες συχνά προσποιούνται συνομηλίκους ή προσφέρουν επιβεβαίωση, δώρα ή επαίνους.

Παράδειγμα: Κορίτσι 14 ετών που παίζει διαδικτυακά παιχνίδια προσκαλείται σε ιδιωτικές συνομιλίες από άτομο που την κολακεύει και αργότερα ζητά φωτογραφίες και μυστικά.

Σημείωση: Η αποπλάνηση συχνά δεν ξεκινά με απειλές—αρχίζει με φιλικότητα. Οι νέοι μπορεί να μην αντιληφθούν ότι χειραγωγούνται.

7. Δημοσιοποίηση προσωπικών δεδομένων (Doxxing)

Δημόσια κοινοποίηση προσωπικών πληροφοριών (όνομα, διεύθυνση, τηλέφωνο, σχολείο) με σκοπό τον εκφοβισμό ή την υποκίνηση άλλων να στοχοποιήσουν το άτομο. Συχνά ακολουθεί διαδικτυακές διαφωνίες, ακτιβισμό ή αποκαλύψεις ταυτότητας.

Παράδειγμα: Αφού νέος/α αναρτήσει βίντεο υπέρ των ΛΟΑΤΚΙ+ δικαιωμάτων στο TikTok, λογαριασμός troll δημοσιεύει τη διεύθυνση κατοικίας του/της στα σχόλια.

Κάθε μορφή διαδικτυακής έμφυλης βίας μπορεί να εμφανίζεται με διαφορετικό τρόπο, αλλά όλες μπορούν να επηρεάσουν την ψυχική υγεία, την αυτοπεποίθηση, την ασφάλεια και την ελευθερία ενός νέου ατόμου. Οι επαγγελματίες νεολαίας, οι εκπαιδευτικοί και οι συνομήλικοι σύμμαχοι διαδραματίζουν κρίσιμο ρόλο στην αναγνώριση των προειδοποιητικών ενδείξεων, στη δημιουργία ασφαλέστερων ψηφιακών περιβαλλόντων και στο να βοηθούν τους νέους να κατανοήσουν τι δεν είναι αποδεκτό. Το Σχήμα 1 συνοψίζει ορισμένες μορφές διαδικτυακής έμφυλης βίας.

| Μορφή | Ορισμός | Ενδεικτικά Στοιχεία | Πρακτική στην Εργασία με Νέους | Παράδειγμα Σεναρίου |

|---|---|---|---|---|

| Κυβερνοπαρακολούθηση & ψηφιακή επιτήρηση | Επίμονη, ανεπιθύμητη παρακολούθηση μέσω εφαρμογών, GPS ή λογαριασμών για τον εντοπισμό της κίνησης ή της διαδικτυακής δραστηριότητας κάποιου. | Οι Rogers et al. (2022) εντοπίζουν συνήθεις τακτικές όπως spyware, κοινόχρηστους κωδικούς cloud και εκμετάλλευση λειτουργιών «Εύρεση συσκευής». | Ρωτήστε: Γνωρίζουν οι νέοι για κρυφές εφαρμογές ή κοινόχρηστα διαπιστευτήρια; Προωθήστε ελέγχους τεχνολογικής ασφάλειας και ψηφιακά όρια. | Έφηβη αναφέρει ότι ο πρώην σύντροφός της γνωρίζει ακόμη πού βρίσκεται μετά τον χωρισμό, παρά το μπλοκάρισμα. |

| Κυβερνοπαρενόχληση | Επαναλαμβανόμενη αποστολή απειλών, προσβολών ή εξευτελιστικού περιεχομένου μέσω ψηφιακών πλατφορμών. | Οι Henry & Powell (2018) δείχνουν ότι η διαδικτυακή κακοποίηση συχνά μιμείται παραδοσιακά πρότυπα ενδοσυντροφικής βίας, ιδίως σε χωρισμούς. | Υποστηρίξτε τους νέους στη διατήρηση αποδεικτικών στοιχείων, στην αναφορά στις πλατφόρμες και στη διαχείριση των συναισθηματικών επιπτώσεων. | Μαθητής/μαθήτρια λαμβάνει καθημερινά προσβλητικά ηχητικά μηνύματα από συμμαθητή/τρια σε ομαδική συνομιλία. |

| Διαδικτυακός εκφοβισμός | Παρενόχληση ή εξευτελισμός ανηλίκων στο διαδίκτυο, συχνά σε σχολικά ή συνομηλίκων πλαίσια. | Οι Stonard et al. (2014) επισημαίνουν ότι η τεχνολογία επεκτείνει τον εκφοβισμό από το σχολικό ωράριο στους ιδιωτικούς χώρους. | Ενθαρρύνετε θετικούς κανόνες σε συνομηλικούς χώρους· χρησιμοποιήστε παιχνίδια ρόλων για ανάπτυξη ενσυναίσθησης και δεξιοτήτων παρέμβασης. | Ομάδα κοριτσιών δημιουργεί memes για το σώμα συμμαθήτριας και τα κοινοποιεί στο Snapchat. |

| Διαδικτυακός έμφυλος λόγος μίσους | Επιθετική, υποτιμητική ρητορική που στοχοποιεί άτομο λόγω φύλου ή ταυτότητας. | Οι Powell et al. (2022) περιγράφουν πώς ο λόγος μίσους στοχοποιεί γυναίκες και ΛΟΑΤΚΙ+ άτομα μέσω συνδυαστικών επιθέσεων (π.χ. σεξισμός και ομοφοβία). | Προετοιμάστε τους νέους να αναγνωρίζουν και να αντιδρούν στον λόγο μίσους, όχι απλώς να τον αγνοούν ή να «κάνουν scroll». | Μη δυαδικός/ή έφηβος/η δέχεται επανειλημμένα λανθασμένη προσφώνηση και υβριστικούς χαρακτηρισμούς σε Discord server παιχνιδιών. |

| Μη συναινετική κοινοποίηση προσωπικού υλικού («εκδικητική πορνογραφία») | Κοινοποίηση ιδιωτικών εικόνων ή βίντεο χωρίς συναίνεση, συχνά από πρώην συντρόφους ή συνομηλίκους. | Οι Lippman & Campbell (2014) δείχνουν ότι οι έφηβοι συχνά πιέζονται να στείλουν γυμνές φωτογραφίες, οι οποίες αναδιανέμονται χωρίς συναίνεση. | Εκπαιδεύστε τους νέους σχετικά με τα νομικά δικαιώματα, τη συναίνεση και τις συναισθηματικές συνέπειες της κοινοποίησης εικόνων. | Αγόρι απειλεί να δημοσιεύσει φωτογραφία της πρώην του αν δεν δεχτεί να του μιλήσει ξανά. |

| Διαδικτυακή αποπλάνηση ανηλίκου | Χειραγώγηση ανηλίκου ώστε να αναπτύξει εμπιστοσύνη ή εξάρτηση για σεξουαλικούς σκοπούς—διαδικτυακά ή εκτός διαδικτύου. | Οι Wolak et al. (2008) διαπίστωσαν ότι οι περισσότερες περιπτώσεις ξεκινούν με κολακεία και εξελίσσονται σταδιακά σε χειραγώγηση. | Τονίστε πώς οι δράστες χτίζουν εμπιστοσύνη και όχι μόνο πώς χρησιμοποιούν απειλές· ενισχύστε τον ψηφιακό γραμματισμό των νέων. | 15χρονος/η προσκαλείται σε ιδιωτική συνομιλία από άγνωστο που υπόσχεται ανταμοιβές σε διαδικτυακό παιχνίδι. |

🤖 Ο Ρόλος της Τεχνητής Νοημοσύνης στην Έμφυλη Βία

Η Τεχνητή Νοημοσύνη (ΤΝ) αλλάζει τον τρόπο με τον οποίο επικοινωνούμε, αλληλεπιδρούμε και έχουμε πρόσβαση σε πληροφορίες—ιδίως στους ψηφιακούς χώρους όπου οι νέοι περνούν μεγάλο μέρος του χρόνου τους. Ωστόσο, πέρα από τα οφέλη της, η ΤΝ αναδιαμορφώνει και τον τρόπο με τον οποίο μπορεί να προκληθεί βλάβη, συμπεριλαμβανομένης της έμφυλης βίας (GBV).

Η ενότητα αυτή εξετάζει πώς οι τεχνολογίες ΤΝ μπορούν να χρησιμοποιηθούν τόσο για τη διευκόλυνση της κακοποίησης όσο και για την υποστήριξη της πρόληψης και της αντιμετώπισής της. Παρέχει πρακτικές πληροφορίες για επαγγελματίες νεολαίας και εκπαιδευτικούς που επιθυμούν να κατανοήσουν τα εργαλεία, τους κινδύνους και τις ευκαιρίες που φέρνει η ΤΝ στην πράξη τους.

Η συζήτηση αναδεικνύει επίσης τις ηθικές προκλήσεις της χρήσης αυτοματοποιημένων συστημάτων σε ευαίσθητα πλαίσια και εξετάζει τους περιορισμούς των υφιστάμενων συνόλων δεδομένων και προσεγγίσεων σχεδιασμού, ιδίως όταν απουσιάζει η συμβολή νέων ή περιθωριοποιημένων κοινοτήτων.

Είναι σημαντικό να τονιστεί ότι η βία που διευκολύνεται από την ΤΝ δεν αποτελεί κάτι εντελώς νέο. Αντιπροσωπεύει τη συνέχιση της έμφυλης βίας μέσω νέων ψηφιακών καναλιών και όχι μια ξεχωριστή ή απομονωμένη μορφή. Ως μέρος της συνέχειας μεταξύ διαδικτυακής και εκτός διαδικτύου έμφυλης βίας, πολλές από τις βλάβες που παρατηρούμε σήμερα—όπως η επιτήρηση, ο εξαναγκασμός ή η κακοποίηση μέσω εικόνων—αντανακλούν πρότυπα εξουσίας και ελέγχου που υπάρχουν και εκτός διαδικτύου. Η τεχνολογία δεν δημιούργησε αυτές τις συμπεριφορές, αλλά τις ενίσχυσε, τις αυτοματοποίησε και τις κλιμάκωσε, συχνά με τρόπους που είναι δυσκολότερο να εντοπιστούν ή να αντιμετωπιστούν.

Η Τεχνητή Νοημοσύνη μπορεί να αποτελέσει ισχυρό εργαλείο—αλλά, όπως πολλές τεχνολογίες, μπορεί και να χρησιμοποιηθεί καταχρηστικά. Στο πλαίσιο της έμφυλης βίας, η ΤΝ έχει επιτρέψει νέες μεθόδους παρενόχλησης, διαπόμπευσης ή ελέγχου, ιδιαίτερα σε ψηφιακούς χώρους όπου οι νέοι είναι πιο ενεργοί.

Μία από τις πιο ανησυχητικές εξελίξεις είναι η χρήση deepfakes—εικόνων ή βίντεο που δημιουργούνται με ΤΝ και τοποθετούν το πρόσωπο κάποιου σε πορνογραφικό περιεχόμενο χωρίς τη συναίνεσή του. Αυτά τα ψεύτικα αρχεία συχνά κοινοποιούνται σε μέσα κοινωνικής δικτύωσης ή κρυπτογραφημένες εφαρμογές ανταλλαγής μηνυμάτων. Ακόμη και όταν είναι εμφανώς κατασκευασμένα, τα θύματα—συχνά κορίτσια, νεαρές γυναίκες και ΛΟΑΤΚΙ+ νέοι—αναφέρουν ότι αισθάνονται ταπεινωμένα, φοβισμένα και κοινωνικά απομονωμένα (Umbach et al., 2024).

Μια άλλη συχνή κατάχρηση της ΤΝ είναι η δημιουργία bots παρενόχλησης: αυτοματοποιημένοι λογαριασμοί που έχουν προγραμματιστεί να στέλνουν βίαια, υποτιμητικά ή απειλητικά μηνύματα μαζικά. Αυτά τα bots στοχοποιούν συχνά νέους ακτιβιστές, influencers ή οποιονδήποτε μιλά δημόσια για ζητήματα φύλου, σεξουαλικότητας ή δικαιοσύνης. Ο τεράστιος όγκος των μηνυμάτων μπορεί να κάνει την κακοποίηση να φαίνεται αδιάκοπη και αδύνατο να αποφευχθεί (Powell et al., 2022).

Η ΤΝ μπορεί επίσης να συμβάλει στη βλάβη χωρίς άμεση κακόβουλη πρόθεση. Οι αλγόριθμοι των πλατφορμών που δίνουν προτεραιότητα σε περιεχόμενο με υψηλή αλληλεπίδραση τείνουν να προωθούν αναρτήσεις που προκαλούν θυμό ή αγανάκτηση. Αυτό σημαίνει ότι μισογυνικό ή τρανσφοβικό περιεχόμενο συχνά φτάνει σε περισσότερα άτομα—όχι επειδή οι πλατφόρμες θέλουν να το προωθήσουν, αλλά επειδή τα συστήματα ΤΝ έχουν σχεδιαστεί για να μεγιστοποιούν την προσοχή και όχι την ασφάλεια (Henry & Powell, 2018).

Τέλος, τεχνολογίες που βασίζονται σε ΤΝ και χρησιμοποιούνται σε «έξυπνα» σπίτια, φορητές συσκευές ή εφαρμογές ψυχικής υγείας μπορεί να μετατραπούν σε εργαλεία επιτήρησης. Ένας κακοποιητής θα μπορούσε να χρησιμοποιήσει αυτά τα συστήματα για να παρακολουθεί την τοποθεσία κάποιου, να έχει πρόσβαση σε ιδιωτικά μηνύματα ή να ερμηνεύει συναισθηματικές καταστάσεις χωρίς συναίνεση. Τα θύματα ενδέχεται να μην γνωρίζουν καν ότι παρακολουθούνται (Powell et al., 2022).

Αυτοί οι κίνδυνοι αναδεικνύουν ένα βασικό μήνυμα: η ΤΝ δεν προκαλεί την κακοποίηση, αλλά μπορεί να χρησιμοποιηθεί ως όπλο από άτομα με επιβλαβείς προθέσεις. Για επαγγελματίες νεολαίας, κοινωνικούς λειτουργούς και εκπαιδευτικούς, η κατανόηση του τρόπου λειτουργίας αυτών των τεχνολογιών—και της σύνδεσής τους με προϋπάρχοντα πρότυπα εκτός διαδικτύου βίας—είναι ουσιώδης για την προστασία και ενδυνάμωση των νέων, όπως φαίνεται στον Πίνακα 2.

| Μέθοδος Κακοποίησης | Περιγραφή | Παράδειγμα από την Πραγματική Ζωή | Αναφορά |

|---|---|---|---|

| Deepfakes | Εικόνες ή βίντεο που δημιουργούνται με ΤΝ και τοποθετούν το πρόσωπο κάποιου σε σεξουαλικό περιεχόμενο | Έφηβη ανακαλύπτει ότι κυκλοφορεί πορνογραφικό βίντεο στο οποίο το πρόσωπό της έχει προστεθεί με τεχνολογία deepfake | Umbach et al. (2024) |

| Bots παρενόχλησης | Αυτοματοποιημένοι λογαριασμοί που διαδίδουν απειλητικό ή υποτιμητικό περιεχόμενο, συχνά στοχοποιώντας ακτιβιστές ή περιθωριοποιημένες ομάδες | Νεαρή ακτιβίστρια για το κλίμα λαμβάνει εκατοντάδες υβριστικά μηνύματα που δημιουργήθηκαν με ΤΝ μετά από δημόσια ομιλία | Powell et al. (2022) |

| Αλγοριθμική ενίσχυση μίσους | Οι αλγόριθμοι πλατφορμών προωθούν μισαλλόδοξες ή προκλητικές αναρτήσεις για αύξηση αλληλεπίδρασης, εκθέτοντας τα θύματα σε μαζική κακοποίηση | ΛΟΑΤΚΙ+ influencers αναφέρουν έξαρση επιθέσεων μετά από αναρτήσεις για το Pride, λόγω αλγορίθμων προτάσεων | Henry & Powell (2018) |

| Εκμετάλλευση δεδομένων | Συστήματα ΤΝ διαρρέουν ιδιωτικά δεδομένα μέσω «έξυπνων» συσκευών ή εξάγουν ευαίσθητες πληροφορίες χωρίς συναίνεση | Έξυπνο ηχείο σε σπίτι εφήβου καταγράφει ιδιωτικούς καβγάδες και μεταφέρει τα αρχεία σε διακομιστή cloud χωρίς συναίνεση | Powell et al. (2022) |

Παρότι οι τεχνολογίες ΤΝ μπορούν να χρησιμοποιηθούν καταχρηστικά, διαθέτουν επίσης σημαντικό δυναμικό για την πρόληψη, την έγκαιρη ανίχνευση και την υποστήριξη επιζώντων σε περιπτώσεις έμφυλης βίας (GBV). Όταν αναπτύσσονται και εφαρμόζονται με ηθικό τρόπο, η ΤΝ μπορεί να ενισχύσει την ασφάλεια και να βελτιώσει την πρόσβαση σε υπηρεσίες υποστήριξης για άτομα που επηρεάζονται από διαδικτυακή κακοποίηση.

Μία από τις πιο αποτελεσματικές χρήσεις της ΤΝ είναι στον εντοπισμό και την αφαίρεση επιβλαβούς περιεχομένου. Εργαλεία που χρησιμοποιούν αναγνώριση εικόνας, όπως αυτά που βασίζονται στο PhotoDNA της Microsoft, βοηθούν ήδη τις πλατφόρμες να εντοπίζουν και να μπλοκάρουν γνωστό υλικό σεξουαλικής κακοποίησης ανηλίκων (CSAM). Τα συστήματα αυτά συγκρίνουν εικόνες που ανεβάζουν οι χρήστες με ασφαλείς βάσεις δεδομένων ήδη αναφερόμενου υλικού κακοποίησης. Αν και δεν μπορούν να αποτρέψουν τη δημιουργία νέου υλικού, αποτελούν σημαντικό μηχανισμό προστασίας (UNICEF, 2022).

Η ΤΝ χρησιμοποιείται επίσης για τη λειτουργία chatbots και εικονικών βοηθών που βοηθούν επιζώντες να βρουν την υποστήριξη που χρειάζονται. Αυτά τα εργαλεία είναι ιδιαίτερα χρήσιμα για νέους που μπορεί να διστάζουν να μιλήσουν σε κάποιον/α πρόσωπο με πρόσωπο. Τα chatbots μπορούν να καθοδηγήσουν τους χρήστες μέσα από ερωτήσεις σχετικά με τις εμπειρίες τους και να τους συνδέσουν με κατάλληλες υπηρεσίες ψυχικής υγείας, νομικής υποστήριξης ή έκτακτης ανάγκης. Όταν σχεδιάζονται με τραυματοκεντρικές αρχές και είναι διαθέσιμα σε πολλές γλώσσες, μπορούν να αποτελέσουν ένα ασφαλές πρώτο βήμα προς τη βοήθεια (Musharu et al., 2025).

Η Επεξεργασία Φυσικής Γλώσσας (NLP), μορφή ΤΝ που βοηθά τους υπολογιστές να κατανοούν την ανθρώπινη γλώσσα, χρησιμοποιείται για τον εντοπισμό και το μπλοκάρισμα λόγου μίσους. Πλατφόρμες όπως το X (πρώην Twitter), το Instagram και το TikTok αξιοποιούν ολοένα και περισσότερο μοντέλα NLP για τον έλεγχο αναρτήσεων και τη λήψη μέτρων κατά κακοποιητικής ή απειλητικής γλώσσας. Παρότι αυτά τα εργαλεία δεν είναι τέλεια, συμβάλλουν στη μείωση της ορατής βλάβης και στην προστασία των χρηστών από τις ψυχολογικές επιπτώσεις της στοχευμένης παρενόχλησης (Powell et al., 2022).

Υπάρχουν επίσης πιλοτικές δοκιμές ΤΝ για πρόληψη και συστήματα έγκαιρης προειδοποίησης. Ορισμένες εφαρμογές αναλύουν τη συμπεριφορά των χρηστών, όπως τον τόνο των μηνυμάτων ή τη συχνότητα επικοινωνίας, για να εντοπίσουν μοτίβα που μπορεί να υποδηλώνουν κίνδυνο. Σε ορισμένα πλαίσια ενδοοικογενειακής βίας, διερευνάται η χρήση εργαλείων ΤΝ για τον εντοπισμό υψηλού κινδύνου πριν προκύψει σωματική βλάβη. Αυτά τα προγνωστικά μοντέλα πρέπει να χρησιμοποιούνται με προσοχή ώστε να αποφεύγονται ψευδώς θετικά αποτελέσματα ή παραβιάσεις ιδιωτικότητας, αλλά δείχνουν προοπτικές για βελτίωση της έγκαιρης παρέμβασης (Henry & Powell, 2018).

Η αξία αυτών των εργαλείων δεν εξαρτάται μόνο από την τεχνολογία, αλλά και από τον τρόπο με τον οποίο εισάγονται, εξηγούνται και ρυθμίζονται. Εργαλεία που συν-σχεδιάζονται με νέους, επιζώντες και οργανώσεις της κοινότητας είναι πιο πιθανό να ανταποκρίνονται σε πραγματικές ανάγκες και να κερδίζουν την εμπιστοσύνη των χρηστών (βλ. Πίνακα 3).

| Εφαρμογή ΤΝ | Περιγραφή | Παράδειγμα | Παραπομπή |

|---|---|---|---|

| Ανίχνευση εικόνων | Εργαλεία ΤΝ ανιχνεύουν γνωστό ή ύποπτο κακοποιητικό περιεχόμενο (π.χ. γυμνά χωρίς συναίνεση) και το επισημαίνουν/το αφαιρούν από τις πλατφόρμες | Η Meta χρησιμοποιεί εργαλεία τύπου PhotoDNA για να μπλοκάρει μεταφορτώσεις γνωστού υλικού σεξουαλικής κακοποίησης παιδιών (CSAM) | UNICEF (2022) |

| Chatbots διαλογής (triage) | Bot με ΤΝ καθοδηγούν επιζώντες/επιζώσες στις κατάλληλες υπηρεσίες, 24/7, με ροές υποστήριξης βασισμένες σε τραυματο-ενημερωμένη προσέγγιση | Ένας/μία νέος/νέα χρησιμοποιεί chatbot υποστήριξης στο WhatsApp για να βρει υπηρεσίες ψυχικής υγείας στη γλώσσα του/της | Musharu et al. (2025) |

| NLP για ανίχνευση ρητορικής μίσους | Η Επεξεργασία Φυσικής Γλώσσας (NLP) χρησιμοποιείται για την αυτόματη επισήμανση μισογυνικών ή τρανσφοβικών αναρτήσεων | Το Twitter εφαρμόζει ταξινομητές περιεχομένου που έχουν εκπαιδευτεί σε σύνολα δεδομένων ρητορικής μίσους | Powell et al. (2022) |

| Προγνωστική αστυνόμευση ή έγκαιρη προειδοποίηση | Σε ορισμένες δοκιμές, η ΤΝ χρησιμοποιείται για να αναλύει μοτίβα κινδύνου σε κακοποιητικές συμπεριφορές και να ενεργοποιεί ειδοποιήσεις ή πρόληψη | Πρωτότυπες εφαρμογές αξιολογούν μοτίβα κλιμάκωσης σε περιστατικά ενδοοικογενειακής βίας (DV) με βάση τον τόνο + τη συχνότητα των SMS | Henry & Powell (2018) |

Καθώς η ΤΝ χρησιμοποιείται ολοένα και περισσότερο στον αγώνα κατά της έμφυλης βίας (GBV), είναι απαραίτητο να κατανοούμε όχι μόνο τις δυνατότητές της, αλλά και τους περιορισμούς και τους κινδύνους της. Τα εργαλεία ΤΝ δεν είναι ουδέτερα. Διαμορφώνονται από τα δεδομένα με τα οποία εκπαιδεύονται, τους στόχους των δημιουργών τους και τα κοινωνικά περιβάλλοντα στα οποία εφαρμόζονται. Χωρίς την κατάλληλη εποπτεία, αυτά τα εργαλεία μπορεί άθελά τους να ενισχύσουν τις ανισότητες, να εκθέσουν επιζώντες/επιζώσες σε νέες μορφές βλάβης ή να αποτύχουν να προστατεύσουν όσους/όσες έχουν σχεδιαστεί να βοηθούν.

Ένα βασικό ζήτημα είναι η μεροληψία (bias) στα μοντέλα ΤΝ. Πολλά συστήματα που χρησιμοποιούνται για την ανίχνευση ρητορικής μίσους, κακοποιητικών μηνυμάτων ή επιβλαβών εικόνων εκπαιδεύονται σε δεδομένα που υποεκπροσωπούν ορισμένες ομάδες ή γλώσσες. Ως αποτέλεσμα, κακοποίηση που στοχεύει γυναίκες διαφορετικού χρώματος, ΛΟΑΤΚΙ+ άτομα ή μη δυτικούς/ές χρήστες/ριες μπορεί να μην ανιχνεύεται. Σε ορισμένες περιπτώσεις, νόμιμες εκφράσεις θυμού ή απογοήτευσης από επιζώντες/επιζώσες έχουν επισημανθεί λανθασμένα ως κακοποιητικές, ενώ πραγματικές απειλές παραμένουν online (Powell et al., 2022).

Ένας ακόμη κίνδυνος είναι η έλλειψη διαφάνειας στο πώς τα εργαλεία ΤΝ λαμβάνουν αποφάσεις. Οι επιζώντες/επιζώσες μπορεί να μην γνωρίζουν γιατί αφαιρέθηκε μια ανάρτηση ή γιατί ένα chatbot έδωσε μια συγκεκριμένη απάντηση. Αυτό το πρόβλημα «μαύρου κουτιού» μειώνει την εμπιστοσύνη στα συστήματα ΤΝ και περιορίζει τη λογοδοσία. Για τους νέους/τις νέες, που συχνά είναι λιγότερο εξοικειωμένοι/ες με τα ψηφιακά τους δικαιώματα, μπορεί να οδηγήσει σε σύγχυση ή απογοήτευση όταν προσπαθούν να ζητήσουν βοήθεια online (Henry & Powell, 2018).

Η κακή χρήση επιτήρησης αποτελεί επίσης ένα αυξανόμενο πρόβλημα. Εργαλεία ΤΝ που έχουν σχεδιαστεί για να προστατεύουν τους/τις χρήστες/ριες, όπως ιχνηλάτες τοποθεσίας ή λογισμικό αναγνώρισης συναισθημάτων, μπορούν να «οπλοποιηθούν» από κακοποιητές/τριες. Αν οι εφαρμογές ασφάλειας δεν έχουν αυστηρές δικλείδες προστασίας ιδιωτικότητας, μπορεί να χρησιμοποιηθούν για την παρακολούθηση ή τον έλεγχο των θυμάτων αντί να τα βοηθούν. Αυτό είναι ιδιαίτερα επικίνδυνο σε περιπτώσεις ενδοοικογενειακής βίας, όπου η τεχνολογία αποτελεί ήδη μέρος του μοτίβου εξαναγκαστικού ελέγχου (UNESCO, 2023).

Η έλλειψη συμμετοχής των νέων στον σχεδιασμό αυτών των εργαλείων είναι ένα ακόμη κρίσιμο κενό. Οι νέοι/οι νέες συχνά έχουν ιδιαίτερες εμπειρίες διαδικτυακής κακοποίησης, αλλά σπάνια συμμετέχουν στην ανάπτυξη λύσεων ψηφιακής ασφάλειας. Αυτό μπορεί να οδηγήσει σε εργαλεία που δεν ανταποκρίνονται στις ανάγκες τους, χρησιμοποιούν μπερδεμένη γλώσσα ή χάνουν σημαντικό πλαίσιο, όπως αργκό, πολιτισμικούς κανόνες ή κινδύνους που σχετίζονται με συγκεκριμένες πλατφόρμες (Musharu et al., 2025).

Τέλος, υπάρχει έλλειψη διαχρονικών (longitudinal) δεδομένων για το τι πραγματικά λειτουργεί. Πολλές παρεμβάσεις που βασίζονται σε ΤΝ είναι πιλοτικά έργα ή εμπορικά προϊόντα με περιορισμένη διαφάνεια. Χωρίς ανεξάρτητη αξιολόγηση και δημόσια διαθέσιμα δεδομένα, είναι δύσκολο να εκτιμηθεί αν αυτά τα εργαλεία μειώνουν τη βλάβη με την πάροδο του χρόνου ή απλώς μετακινούν το πρόβλημα σε άλλες πλατφόρμες ή πληθυσμούς.

- Σέβεται το εργαλείο την ιδιωτικότητα; Αποθηκεύονται τα δεδομένα με ασφάλεια και μπορούν οι νέοι/οι νέες να το χρησιμοποιούν χωρίς να μοιράζονται ευαίσθητες πληροφορίες;

- Είναι η γλώσσα προσβάσιμη σε όλους/όλες τους/τις νέους/νέες; Αποφεύγει το εργαλείο την ορολογία και λαμβάνει υπόψη διαφορές ηλικίας, υπόβαθρου και ψηφιακού γραμματισμού;

- Υπάρχουν κίνδυνοι ενίσχυσης στερεοτύπων; Αναγνωρίζει το σύστημα ποικίλες ταυτότητες και αποφεύγει μεροληψίες φύλου, φυλής ή πολιτισμού;

- Είναι διαφανές ως προς το πώς λειτουργεί; Μπορούν οι χρήστες/ριες να κατανοήσουν πώς λαμβάνονται οι αποφάσεις και τι συμβαίνει με τα δεδομένα τους;

- Σχεδιάστηκε με τη συμβολή των νέων; Έχουν οι νέοι/οι νέες δοκιμάσει ή συμβάλει στη διαμόρφωση του εργαλείου ώστε να είναι σχετικό και συμπεριληπτικό;

| Ηθική πρόκληση | Περιγραφή | Επίπτωση |

|---|---|---|

| Έλλειψη διαφάνειας | Πολλά εργαλεία ΤΝ λειτουργούν ως «μαύρα κουτιά» και δεν είναι σαφές πώς λαμβάνονται οι αποφάσεις | Οι επιζώντες/επιζώσες μπορεί να μην εμπιστεύονται αυτοματοποιημένα εργαλεία ή να μην κατανοούν πώς χρησιμοποιούνται τα δεδομένα τους |

| Μεροληψία και λανθασμένη ταξινόμηση | Η ΤΝ μπορεί να αντανακλά κοινωνικές μεροληψίες, αποτυγχάνοντας να ανιχνεύσει κακοποίηση απέναντι σε περιθωριοποιημένους/ες χρήστες/ριες | Συστήματα NLP μπορεί να μην εντοπίζουν μίσος απέναντι σε μη δυτικές ταυτότητες φύλου |

| Κίνδυνοι επιτήρησης | Εργαλεία που προορίζονται για προστασία μπορεί να αξιοποιηθούν για παρενόχληση ή κακοποίηση | Λειτουργίες εντοπισμού τοποθεσίας ή ανίχνευσης συναισθήματος μπορεί να στραφούν εναντίον των θυμάτων |

| Έλλειψη της φωνής των νέων στον σχεδιασμό | Λίγα εργαλεία ΤΝ συν-σχεδιάζονται με νέους/νέες, οδηγώντας σε αστοχίες στη χρηστικότητα ή την ασφάλεια | Chatbots μπορεί να αγνοούν τοπική αργκό ή συναισθηματικές αποχρώσεις που είναι σημαντικές για τους/τις νέους/νέες |

🛡️ Ασφαλείς πρακτικές στο διαδίκτυο

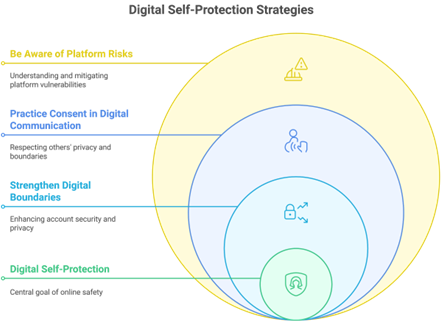

Αυτή η ενότητα παρουσιάζει πρακτικές στρατηγικές για την ασφαλέστερη πλοήγηση και υποστήριξη διαδικτυακών εμπειριών απέναντι στην έμφυλη βία (GBV). Εξετάζει πώς οι/οι youth workers μπορούν να βοηθήσουν στη μείωση του κινδύνου βλάβης, ενισχύοντας συνήθειες ψηφιακής ασφάλειας, ανταποκρινόμενοι αποτελεσματικά σε περιστατικά διαδικτυακής κακοποίησης και ενθαρρύνοντας επικοινωνία με σεβασμό και ενδυνάμωση. Η ενότητα εξετάζει επίσης πώς οι θετικοί κανόνες μεταξύ συνομηλίκων και οι παρεμβάσεις των παρευρισκόμενων (bystanders) μπορούν να μετατοπίσουν τις διαδικτυακές κουλτούρες προς μεγαλύτερη ασφάλεια και συμπερίληψη. Τέλος, παρέχει καθοδήγηση για τη χρήση εργαλείων ανά πλατφόρμα, ώστε να γίνεται αναφορά κακοποίησης, να προστατεύεται η ιδιωτικότητα και να υποστηρίζεται η ψυχική ευημερία των νέων σε ψηφιακούς χώρους.

Σε έναν ολοένα και πιο ψηφιακό κόσμο, η προστασία των προσωπικών πληροφοριών και η διατήρηση της ιδιωτικότητας είναι υψίστης σημασίας. Αυτή η ενότητα περιγράφει βασικές στρατηγικές που βοηθούν τα άτομα να ενισχύσουν την ψηφιακή αυτοπροστασία τους. Εφαρμόζοντας αυτές τις βασικές πρακτικές, οι χρήστες/ριες μπορούν να θέτουν ισχυρότερα ψηφιακά όρια, να εφαρμόζουν τη συναίνεση στις επικοινωνίες τους και να παραμένουν ενήμεροι/ες για τους κινδύνους που συνδέονται με διαφορετικές πλατφόρμες.

1. Ενισχύστε τα ψηφιακά όρια

- Χρησιμοποιήστε ισχυρούς, μοναδικούς κωδικούς πρόσβασης: Βεβαιωθείτε ότι όλοι οι βασικοί λογαριασμοί προστατεύονται με σύνθετους κωδικούς που δεν είναι εύκολο να μαντευτούν. Σκεφτείτε τη χρήση διαχειριστή κωδικών (password manager) για να τους οργανώνετε.

- Ενεργοποιήστε τον έλεγχο δύο παραγόντων (2FA): Προσθέτει ένα επιπλέον επίπεδο ασφάλειας, απαιτώντας δεύτερη μορφή επαλήθευσης (π.χ. SMS ή εφαρμογή ταυτοποίησης), πέρα από τον κωδικό πρόσβασης.

- Αποφύγετε την κοινοποίηση ζωντανής τοποθεσίας: Μην δημοσιεύετε τοποθεσία σε πραγματικό χρόνο ή ευαίσθητα προσωπικά δεδομένα σε δημόσια φόρουμ, γιατί αυτό μπορεί να σας εκθέσει σε ανεπιθύμητη προσοχή ή κινδύνους.

- Κάντε τακτικούς ελέγχους ιδιωτικότητας: Ελέγχετε συχνά τις ρυθμίσεις ιδιωτικότητας στις πλατφόρμες κοινωνικής δικτύωσης (κοινοποίηση τοποθεσίας, άδειες επισήμανσης/tagging, λίστες ακολούθων), ώστε οι πληροφορίες σας να είναι προσβάσιμες μόνο σε έμπιστα άτομα.

2. Εφαρμόστε τη συναίνεση στην ψηφιακή επικοινωνία

- Ζητήστε άδεια πριν κοινοποιήσετε: Ζητάτε πάντα συναίνεση πριν μοιραστείτε εικόνες ή βίντεο που περιλαμβάνουν άλλα άτομα. Αυτό σέβεται την ιδιωτικότητά τους και την αυτονομία τους.

- Σεβαστείτε τα όρια στα μηνύματα: Πριν προωθήσετε ευαίσθητο περιεχόμενο σε ομαδικές συνομιλίες ή μηνύματα, επικοινωνήστε με τον/την αρχικό/ή αποστολέα για να βεβαιωθείτε ότι είναι/είναι άνετος/η να κοινοποιηθεί.

- Δώστε το παράδειγμα για υγιείς διαδικτυακές σχέσεις: Προωθήστε θετικές αλληλεπιδράσεις αποφεύγοντας χειριστική γλώσσα ή πίεση στις επικοινωνίες, καλλιεργώντας ένα ψηφιακό περιβάλλον σεβασμού.

3. Να γνωρίζετε τους κινδύνους των πλατφορμών

- Γνωρίστε τους κινδύνους διαφορετικών εφαρμογών: Εξοικειωθείτε με το ποιες εφαρμογές έχουν αδύναμες πολιτικές εποπτείας ή επιτρέπουν ανώνυμη κακοποίηση, καθώς αυτό μπορεί να δημιουργεί σημαντικούς κινδύνους για τους/τις χρήστες/ριες.

- Μάθετε πώς να διαχειρίζεστε περιεχόμενο: Κατανοήστε πώς να κάνετε αποκλεισμό (block), σίγαση (mute) ή αναφορά (report) επιβλαβούς περιεχομένου στις βασικές πλατφόρμες, ώστε να προστατεύετε την online εμπειρία σας.

- Αξιοποιήστε λειτουργίες ασφάλειας: Χρησιμοποιήστε δυνατότητες όπως φίλτρα λέξεων-κλειδιών, προειδοποιήσεις περιεχομένου και όρια ακολούθων (π.χ. τη λειτουργία “Close Friends” στο Instagram) για να διαμορφώνετε έναν ασφαλέστερο online χώρο.

Υιοθετώντας αυτές τις στρατηγικές, τα άτομα μπορούν να ενισχύσουν σημαντικά την ψηφιακή αυτοπροστασία τους και να συμβάλουν σε ένα ασφαλέστερο διαδικτυακό περιβάλλον για τους ίδιους/τις ίδιες και για τους άλλους.

Διάβασε κάθε σενάριο παρακάτω και επέλεξε την καταλληλότερη δράση του/της youth worker. Αφού επιλέξεις, θα εμφανιστεί η σωστή απάντηση και μια σύντομη εξήγηση. Πρόκειται μόνο για ενημερωτικούς σκοπούς—δεν αποθηκεύονται βαθμολογίες.

- DeRiggi, M., Henry, N., & Powell, A. (2023). Digital bystanders: What works to support victims of technology-facilitated GBV. Youth & Society. https://doi.org/10.1177/0044118X231163511

- Henry, N., & Powell, A. (2018). Technology-facilitated sexual violence: A literature review of empirical research. Trauma, Violence, & Abuse, 19(2), 195–208. https://doi.org/10.1177/1524838016650189

- Lippman, J. R., & Campbell, S. W. (2014). Damned if you do, damned if you don’t… if you’re a girl: Relational and normative contexts of adolescent sexting in the United States. Journal of Children and Media, 8(4), 371–386. https://doi.org/10.1080/17482798.2014.923009

- Musharu, T., Gomez, J. M., Rosales, M., & Navarro Soria, I. (2025, June). AI and open data for GBV prevention among youth: Ethical governance and policy frameworks in the EU. In Proceedings of the 14th BUIS-Tage Conference on Smart and Sustainable Infrastructures. Oldenburg, Germany.

- Powell, A., Henry, N., Flynn, A., & Sugiura, L. (2022). Online, always: A scoping review of technology-facilitated abuse and gender-based violence in the Global North. Computers in Human Behavior, 129, 107131. https://doi.org/10.1016/j.chb.2021.107131

- Rogers, M. M., Burke, J. G., & Earp, J. A. L. (2022). Technology-facilitated abuse in intimate relationships: A scoping review. Trauma, Violence, & Abuse, 24(4), 2210–2226. https://doi.org/10.1177/15248380221093133

- Stonard, K. E., Bowen, E., Lawrence, T. R., & Price, S. A. (2014). The relevance of technology to the nature, prevalence and impact of adolescent dating violence and abuse: A research synthesis. Aggression and Violent Behavior, 19(4), 390–417. https://doi.org/10.1016/j.avb.2014.06.005

- Umbach, R., Valdez, A., & Dobberstein, D. (2024). Non-consensual deepfake pornography: Evidence from ten countries. Proceedings of CHI ’24. https://doi.org/10.1145/3491102.3517575

- UNESCO. (2023). Exposing technology-facilitated gender-based violence in an era of generative AI. https://unesdoc.unesco.org/ark:/48223/pf0000386461

- UNICEF. (2022). Safer Chatbots: Implementation Guide. https://www.unicef.org/media/114681/file/Safer-Chatbots-Implementation-Guide-2022.pdf

- Wolak, J., Finkelhor, D., Mitchell, K. J., & Ybarra, M. L. (2008). Online “predators” and their victims: Myths, realities, and implications for prevention and treatment. American Psychologist, 63(2), 111–128. https://doi.org/10.1037/0003-066X.63.2.111